假设我们有一个固定样本集  ,它包含

,它包含  个样例。我们可以用批量梯度下降法来求解神经网络。具体来讲,对于单个样例

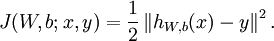

个样例。我们可以用批量梯度下降法来求解神经网络。具体来讲,对于单个样例  ,其代价函数为:

,其代价函数为:

这是一个(二分之一的)方差代价函数。给定一个包含  个样例的数据集,我们可以定义整体代价函数为:

个样例的数据集,我们可以定义整体代价函数为:

以上公式中的第一项  是一个均方差项。第二项是一个规则化项(也叫权重衰减项),其目的是减小权重的幅度,防止过度拟合。

是一个均方差项。第二项是一个规则化项(也叫权重衰减项),其目的是减小权重的幅度,防止过度拟合。

[注:通常权重衰减的计算并不使用偏置项  ,比如我们在

,比如我们在  的定义中就没有使用。一般来说,将偏置项包含在权重衰减项中只会对最终的神经网络产生很小的影响。如果你在斯坦福选修过CS229(机器学习)课程,或者在YouTube上看过课程视频,你会发现这个权重衰减实际上是课上提到的贝叶斯规则化方法的变种。在贝叶斯规则化方法中,我们将高斯先验概率引入到参数中计算MAP(极大后验)估计(而不是极大似然估计)。]

的定义中就没有使用。一般来说,将偏置项包含在权重衰减项中只会对最终的神经网络产生很小的影响。如果你在斯坦福选修过CS229(机器学习)课程,或者在YouTube上看过课程视频,你会发现这个权重衰减实际上是课上提到的贝叶斯规则化方法的变种。在贝叶斯规则化方法中,我们将高斯先验概率引入到参数中计算MAP(极大后验)估计(而不是极大似然估计)。]

权重衰减参数  用于控制公式中两项的相对重要性。在此重申一下这两个复杂函数的含义:

用于控制公式中两项的相对重要性。在此重申一下这两个复杂函数的含义: 是针对单个样例计算得到的方差代价函数;

是针对单个样例计算得到的方差代价函数; 是整体样本代价函数,它包含权重衰减项。

是整体样本代价函数,它包含权重衰减项。

以上的代价函数经常被用于分类和回归问题。在分类问题中,我们用  或

或  ,来代表两种类型的标签(回想一下,这是因为 sigmoid激活函数的值域为

,来代表两种类型的标签(回想一下,这是因为 sigmoid激活函数的值域为 ![\textstyle [0,1]](http://deeplearning.stanford.edu/wiki/images/math/8/4/2/84235d31ac83fe764546463aba7acc0e.png) ;如果我们使用双曲正切型激活函数,那么应该选用

;如果我们使用双曲正切型激活函数,那么应该选用  和

和  作为标签)。对于回归问题,我们首先要变换输出值域(译者注:也就是

作为标签)。对于回归问题,我们首先要变换输出值域(译者注:也就是  ),以保证其范围为

),以保证其范围为 ![\textstyle [0,1]](http://deeplearning.stanford.edu/wiki/images/math/8/4/2/84235d31ac83fe764546463aba7acc0e.png) (同样地,如果我们使用双曲正切型激活函数,要使输出值域为

(同样地,如果我们使用双曲正切型激活函数,要使输出值域为 ![\textstyle [-1,1]](http://deeplearning.stanford.edu/wiki/images/math/8/5/a/85a1c5a07f21a9eebbfb1dca380f8d38.png) )。

)。

我们的目标是针对参数  和

和  来求其函数

来求其函数  的最小值。为了求解神经网络,我们需要将每一个参数

的最小值。为了求解神经网络,我们需要将每一个参数  和

和  初始化为一个很小的、接近零的随机值(比如说,使用正态分布

初始化为一个很小的、接近零的随机值(比如说,使用正态分布  生成的随机值,其中

生成的随机值,其中  设置为

设置为  ),之后对目标函数使用诸如批量梯度下降法的最优化算法。因为

),之后对目标函数使用诸如批量梯度下降法的最优化算法。因为  是一个非凸函数,梯度下降法很可能会收敛到局部最优解;但是在实际应用中,梯度下降法通常能得到令人满意的结果。最后,需要再次强调的是,要将参数进行随机初始化,而不是全部置为

是一个非凸函数,梯度下降法很可能会收敛到局部最优解;但是在实际应用中,梯度下降法通常能得到令人满意的结果。最后,需要再次强调的是,要将参数进行随机初始化,而不是全部置为  。如果所有参数都用相同的值作为初始值,那么所有隐藏层单元最终会得到与输入值有关的、相同的函数(也就是说,对于所有

。如果所有参数都用相同的值作为初始值,那么所有隐藏层单元最终会得到与输入值有关的、相同的函数(也就是说,对于所有  ,

, 都会取相同的值,那么对于任何输入

都会取相同的值,那么对于任何输入  都会有:

都会有: )。随机初始化的目的是使对称失效。

)。随机初始化的目的是使对称失效。

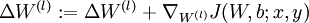

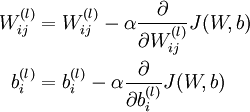

梯度下降法中每一次迭代都按照如下公式对参数  和

和 进行更新:

进行更新:

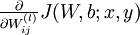

其中  是学习速率。其中关键步骤是计算偏导数。我们现在来讲一下反向传播算法,它是计算偏导数的一种有效方法。

是学习速率。其中关键步骤是计算偏导数。我们现在来讲一下反向传播算法,它是计算偏导数的一种有效方法。

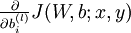

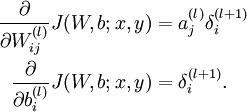

我们首先来讲一下如何使用反向传播算法来计算  和

和  ,这两项是单个样例

,这两项是单个样例  的代价函数

的代价函数  的偏导数。一旦我们求出该偏导数,就可以推导出整体代价函数

的偏导数。一旦我们求出该偏导数,就可以推导出整体代价函数  的偏导数:

的偏导数:

以上两行公式稍有不同,第一行比第二行多出一项,是因为权重衰减是作用于  而不是

而不是  。

。

反向传播算法的思路如下:给定一个样例  ,我们首先进行“前向传导”运算,计算出网络中所有的激活值,包括

,我们首先进行“前向传导”运算,计算出网络中所有的激活值,包括  的输出值。之后,针对第

的输出值。之后,针对第  层的每一个节点

层的每一个节点  ,我们计算出其“残差”

,我们计算出其“残差”  ,该残差表明了该节点对最终输出值的残差产生了多少影响。对于最终的输出节点,我们可以直接算出网络产生的激活值与实际值之间的差距,我们将这个差距定义为

,该残差表明了该节点对最终输出值的残差产生了多少影响。对于最终的输出节点,我们可以直接算出网络产生的激活值与实际值之间的差距,我们将这个差距定义为  (第

(第  层表示输出层)。对于隐藏单元我们如何处理呢?我们将基于节点(译者注:第

层表示输出层)。对于隐藏单元我们如何处理呢?我们将基于节点(译者注:第  层节点)残差的加权平均值计算

层节点)残差的加权平均值计算  ,这些节点以

,这些节点以  作为输入。下面将给出反向传导算法的细节:

作为输入。下面将给出反向传导算法的细节:

- 进行前馈传导计算,利用前向传导公式,得到

直到输出层

直到输出层  的激活值。

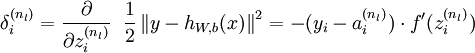

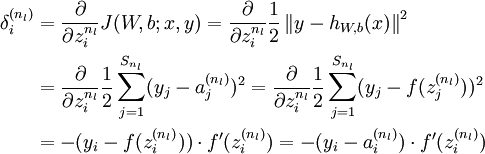

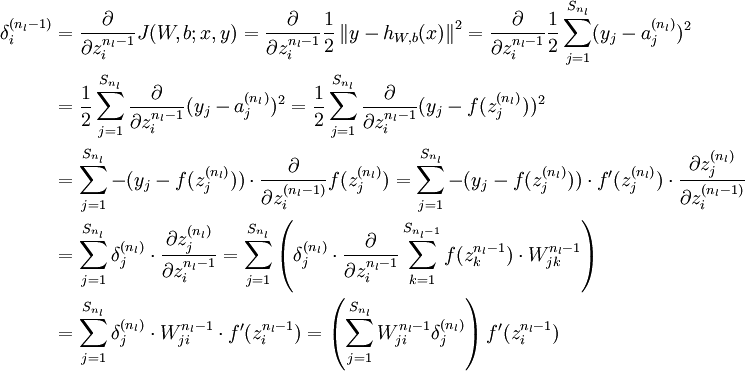

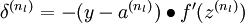

的激活值。 - 对于第

层(输出层)的每个输出单元

层(输出层)的每个输出单元  ,我们根据以下公式计算残差:

,我们根据以下公式计算残差: -

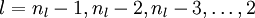

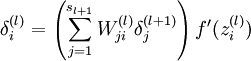

- 对

的各个层,第

的各个层,第  层的第

层的第  个节点的残差计算方法如下:

个节点的残差计算方法如下:  与

与 的关系替换为

的关系替换为 与

与 的关系,就可以得到:

的关系,就可以得到: -

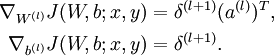

- 计算我们需要的偏导数,计算方法如下:

-

最后,我们用矩阵-向量表示法重写以上算法。我们使用“ ” 表示向量乘积运算符(在Matlab或Octave里用“.*”表示,也称作阿达马乘积)。若

” 表示向量乘积运算符(在Matlab或Octave里用“.*”表示,也称作阿达马乘积)。若  ,则

,则  。在上一个教程中我们扩展了

。在上一个教程中我们扩展了  的定义,使其包含向量运算,这里我们也对偏导数

的定义,使其包含向量运算,这里我们也对偏导数  也做了同样的处理(于是又有

也做了同样的处理(于是又有 ![\textstyle f'([z_1, z_2, z_3]) = [f'(z_1), f'(z_2), f'(z_3)]](http://deeplearning.stanford.edu/wiki/images/math/c/7/5/c7515c53b59e670ceee277e06c1229cb.png) )。

)。

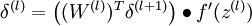

那么,反向传播算法可表示为以下几个步骤:

- 进行前馈传导计算,利用前向传导公式,得到

直到输出层

直到输出层  的激活值。

的激活值。 - 对输出层(第

层),计算:

层),计算: -

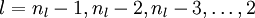

- 对于

的各层,计算:

的各层,计算: -

- 计算最终需要的偏导数值:

-

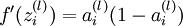

实现中应注意:在以上的第2步和第3步中,我们需要为每一个  值计算其

值计算其  。假设

。假设  是sigmoid函数,并且我们已经在前向传导运算中得到了

是sigmoid函数,并且我们已经在前向传导运算中得到了  。那么,使用我们早先推导出的

。那么,使用我们早先推导出的  表达式,就可以计算得到

表达式,就可以计算得到  。

。

最后,我们将对梯度下降算法做个全面总结。在下面的伪代码中, 是一个与矩阵

是一个与矩阵  维度相同的矩阵,

维度相同的矩阵, 是一个与

是一个与  维度相同的向量。注意这里“

维度相同的向量。注意这里“ ”是一个矩阵,而不是“

”是一个矩阵,而不是“ 与

与  相乘”。下面,我们实现批量梯度下降法中的一次迭代:

相乘”。下面,我们实现批量梯度下降法中的一次迭代:

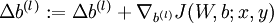

- 对于所有

,令

,令  ,

,  (设置为全零矩阵或全零向量)

(设置为全零矩阵或全零向量) - 对于

到

到  ,

, - 使用反向传播算法计算

和

和  。

。 - 计算

。

。 - 计算

。

。

- 使用反向传播算法计算

- 更新权重参数:

-

现在,我们可以重复梯度下降法的迭代步骤来减小代价函数  的值,进而求解我们的神经网络。

的值,进而求解我们的神经网络。

中英文对照

- 反向传播算法 Backpropagation Algorithm

- (批量)梯度下降法 (batch) gradient descent

- (整体)代价函数 (overall) cost function

- 方差 squared-error

- 均方差 average sum-of-squares error

- 规则化项 regularization term

- 权重衰减 weight decay

- 偏置项 bias terms

- 贝叶斯规则化方法 Bayesian regularization method

- 高斯先验概率 Gaussian prior

- 极大后验估计 MAP

- 极大似然估计 maximum likelihood estimation

- 激活函数 activation function

- 双曲正切函数 tanh function

- 非凸函数 non-convex function

- 隐藏层单元 hidden (layer) units

- 对称失效 symmetry breaking

- 学习速率 learning rate

- 前向传导 forward pass

- 假设值 hypothesis

- 残差 error term

- 加权平均值 weighted average

- 前馈传导 feedforward pass

- 阿达马乘积 Hadamard product

- 前向传播 forward propagation

![\begin{align}J(W,b)&= \left[ \frac{1}{m} \sum_{i=1}^m J(W,b;x^{(i)},y^{(i)}) \right] + \frac{\lambda}{2} \sum_{l=1}^{n_l-1} \; \sum_{i=1}^{s_l} \; \sum_{j=1}^{s_{l+1}} \left( W^{(l)}_{ji} \right)^2 \\&= \left[ \frac{1}{m} \sum_{i=1}^m \left( \frac{1}{2} \left\| h_{W,b}(x^{(i)}) - y^{(i)} \right\|^2 \right) \right] + \frac{\lambda}{2} \sum_{l=1}^{n_l-1} \; \sum_{i=1}^{s_l} \; \sum_{j=1}^{s_{l+1}} \left( W^{(l)}_{ji} \right)^2\end{align}](http://deeplearning.stanford.edu/wiki/images/math/4/5/3/4539f5f00edca977011089b902670513.png)

![\begin{align}\frac{\partial}{\partial W_{ij}^{(l)}} J(W,b) &=\left[ \frac{1}{m} \sum_{i=1}^m \frac{\partial}{\partial W_{ij}^{(l)}} J(W,b; x^{(i)}, y^{(i)}) \right] + \lambda W_{ij}^{(l)} \\\frac{\partial}{\partial b_{i}^{(l)}} J(W,b) &=\frac{1}{m}\sum_{i=1}^m \frac{\partial}{\partial b_{i}^{(l)}} J(W,b; x^{(i)}, y^{(i)})\end{align}](http://deeplearning.stanford.edu/wiki/images/math/9/3/3/93367cceb154c392aa7f3e0f5684a495.png)

![\begin{align}W^{(l)} &= W^{(l)} - \alpha \left[ \left(\frac{1}{m} \Delta W^{(l)} \right) + \lambda W^{(l)}\right] \\b^{(l)} &= b^{(l)} - \alpha \left[\frac{1}{m} \Delta b^{(l)}\right]\end{align}](http://deeplearning.stanford.edu/wiki/images/math/0/f/7/0f7430e97ec4df1bfc56357d1485405f.png)

可视化)

介绍)

聚类分析)

主成分分析)

线性回归)

支持向量机)

图的操作)

最短路径)

条件最短路径)

)

线性规划问题)

最小生成树)