来源:CSDN

历史性时刻!——近日,W3C正式宣告战败:HTML和DOM标准制定权将全权移交给浏览器厂商联盟WHATWG。

由苹果、Google、微软和Mozilla四大浏览器厂商组成的WHATWG已经与万维网联盟(World Wide Web Consortium,即W3C)开展了多年的拉锯战。他们想证明,如果没有他们的支持,W3C将无法管理网络标准。

而经过了多年的PK,W3C终于无奈放权了。

网络标准的分久必合之势

所谓WHATWG,即网页超文本应用技术工作小组(Web Hypertext Application Technology Working Group,简称WHATWG),成立于2004年,其目的是为了推动现代化HTML标准。当时W3C计划将HTML推向XHTML(这是一种类似XML的结构),而各大浏览器厂商表示不同意。

最初,WHATWG由苹果、Opera和Mozilla基金会组成,他们认为处于领导地位的W3C,包括许多与浏览器无关的实体,并没有将Web开发社区的利益放在心上。

于是,他们成立了反W3C联盟组织,并开发了之后的HTML 5标准,后来在得到了所有浏览器厂商的支持后,W3C也正式批准HTML 5标准成为HTML网络标准的主流版本。

两大组织的暗流涌动

多年来,这两大组织一直在通力合作,但大多数与Web标准相关的工作总是由WHATWG出面完成,然后再提交给W3C作为官方标准。

不过在很多时候,Chrome或Mozilla会在得到W3C的最终确定并正式批准之前,领先一步发布所有的建议标准。这表明在大多数情况下,众多浏览器厂商认为W3C的批准只是一种形式,在WHATWG自行决定了某个标准之后,W3C并没有太大影响力。

直到2018年4月,这两大组织出现了正面冲突,当时WHATWG所有的成员——苹果、Google、微软和Mozilla——强烈且明确地反对W3C批准DOM标准4.1。

尽管W3C拥有数百个其他成员,但DOM v4.1标准最终未能推行下去,而且至今也未能在Web浏览器中实现。从那以后,这两大组织一直在制定不同的标准。

HTML和DOM的控制权移交给了WHATWG!

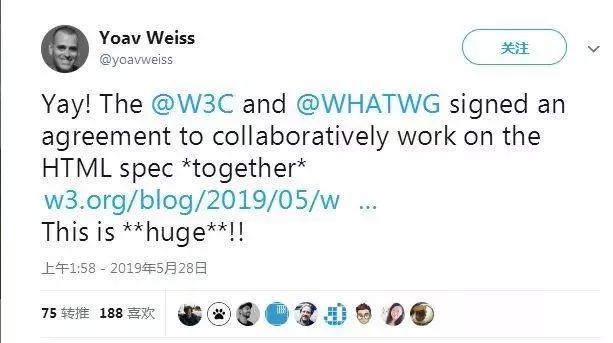

最近,W3C和WHATWG宣布他们将放下分歧,并签署了新的谅解备忘录(https://www.w3.org/2019/04/WHATWG-W3C-MOU.html)。

根据这项新协议,W3C正式放弃发布HTML和DOM标准,他们将支持WHATWG,将控制权完整地交回到浏览器厂商手中。

今后,W3C及其数百名成员将负责起草Web标准的“建议书”。然后,由 WHATWG来决定他们的产品中将包含哪些功能。

WHATWG目前维护的HTML Living Standard(https://html.spec.whatwg.org/multipage/)将成为官方的HTML标准,而DOM Living Standard(https://dom.spec.whatwg.org/)将成为官方的DOM 标准。

这项公告标志着Web标准格局的巨大变化,从此以后,所有重大的Web标准都将由浏览器厂商代替W3C全权负责。

未来智能实验室是人工智能学家与科学院相关机构联合成立的人工智能,互联网和脑科学交叉研究机构。

未来智能实验室的主要工作包括:建立AI智能系统智商评测体系,开展世界人工智能智商评测;开展互联网(城市)云脑研究计划,构建互联网(城市)云脑技术和企业图谱,为提升企业,行业与城市的智能水平服务。

如果您对实验室的研究感兴趣,欢迎加入未来智能实验室线上平台。扫描以下二维码或点击本文左下角“阅读原文”

类型转换函数)

)