一、需求

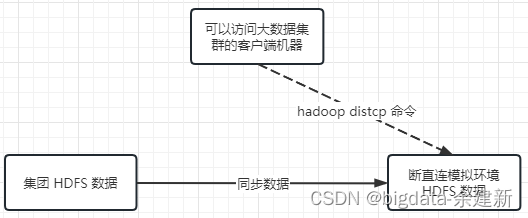

同步集团的数据到断直连环境。

二、思路

三、同步数据(方案)

1、环境:断直连模拟环境

2、操作机器:ETL 机器 XX.14.36.216

3、工作路径:cd /usr/local/fqlhadoop/hadoop/bin

4、执行命令:

命令格式:./hadoop distcp hdfs://${NameNode_IP}:${NameNode_RPC_IP}/${源文件} hdfs://${NameNode_IP}:${NameNode_RPC_IP}/${目标路径}

举例:./hadoop distcp hdfs://XX.10.28.36:8020/spark_udfs hdfs://XX.14.36.216:8020/会运行一个MapReduce任务,来执行拷贝数据的操作。

四、同步数据(实际操作)

# 1、表

## 1.1、分区表

dp_fklh_mart.order_red_blue_flag_hawkeye

f_p_date2023-01-05~2023-01-12## 1.2、非分区表

dp_dict.fund_manage_db_t_merchant_channel# 2、实际操作

2.1、登录到对应环境

先登录到 XX.14.36.220

sudo su - biadmin

然后执行 ssh -p 39000 XX.14.36.2172.2、分区表

## 1. 元数据

提前建表

## 2. 迁移数据

/usr/local/fqlhadoop/hadoop/bin/hadoop distcp \

hdfs://XX.10.28.36:8020/user/hive/warehouse/dp_fklh_mart.db/order_red_blue_flag_hawkeye/f_p_date=2023-01-05 \

hdfs://XX.14.36.216:8020/user/hive/warehouse/dp_fklh_mart.db/order_red_blue_flag_hawkeye## 3. 关联

/usr/local/fqlhadoop/hive/bin/hive 进入交互环境

MSCK REPAIR TABLE order_red_blue_flag_hawkeye;## 4. 验证

/usr/local/fqlhadoop/hive/bin/hive 进入交互环境

SHOW TABLES;

SELECT * FROM ${TABLE_NAME} LIMIT 10;2.3、非分区表

(比分区表操作少了第三步关联的操作)迁移数据

/usr/local/fqlhadoop/hadoop/bin/hadoop distcp \

hdfs://XX.10.28.36:8020/user/hive/warehouse/dp_dict.db/fund_manage_db_t_merchant_channel \

hdfs://XX.14.36.216:8020/user/hive/warehouse/dp_dict.db/

)

)

)

)

SpringBoot整合Curator-开发使用篇)

环境准备)