hive使用的是3.13版本,spark是3.3.3支持hadoop3.x

hive将engine从mr改成spark,通过beeline执行insert、delete时一直报错,sparkTask rpc关闭,

查看yarn是出现ClassNotFoundException: org.apache.hive.spark.client.Job。

开始以为是版本不兼容问题。spark3.3.3编译版本对应的hive是2.3.9

切换hive2.3.9依然是org.apache.hive.spark.client.Job找不到问题。

spark的jars目录存在hive-exec-core-2.3.9.jar,反复对比hive的lib目录,发现是hive-exec.jar没有core,将spark3.3.3下hive的hive-exec-core-2.3.9.jar删掉,替换成hive下的lib文件,重启spark和hive,这个错误消失了

重新执行命令,又出现找不到其他类的情况,可能是spark官方发布的hive相关包和hive发布版的有差别把。什么原因,不知道,先替换试试。替换了还不太行,引发其他问题,自己编译吧

End of LogType:launch_container.sh.This log file belongs to a running container (container_1701103942975_0002_01_000001) and so may not be complete.

环境:hive查询数据,yarn查看日志出现上面的错误

yarn application -list

yarn logs -applicationId application_1701103942975_0002

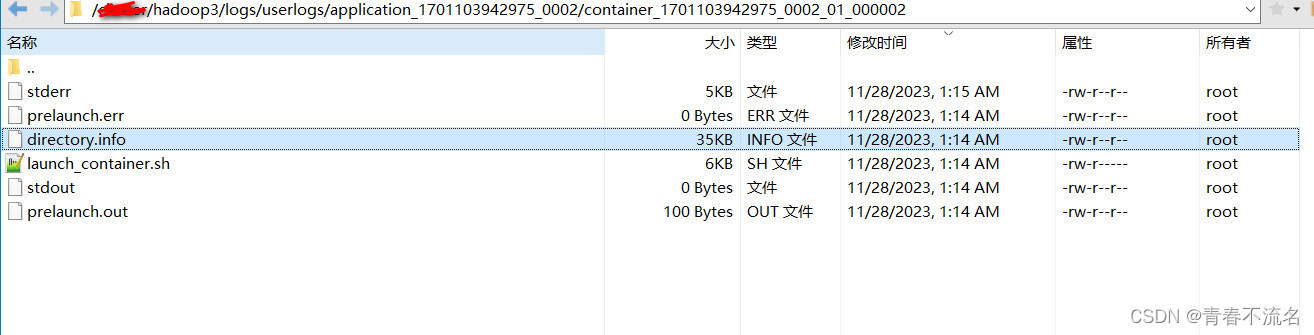

到hadoop的目录查询运行日志

:使用Mistral-7b, LangChain, ChromaDB搭建自己的WEB聊天界面)

![LeetCode [中等]岛屿数量](http://pic.xiahunao.cn/LeetCode [中等]岛屿数量)

解决方案 Vim常用快捷键命令)

❀)

成功举办,信驰达科技携手TI推动技术创新)