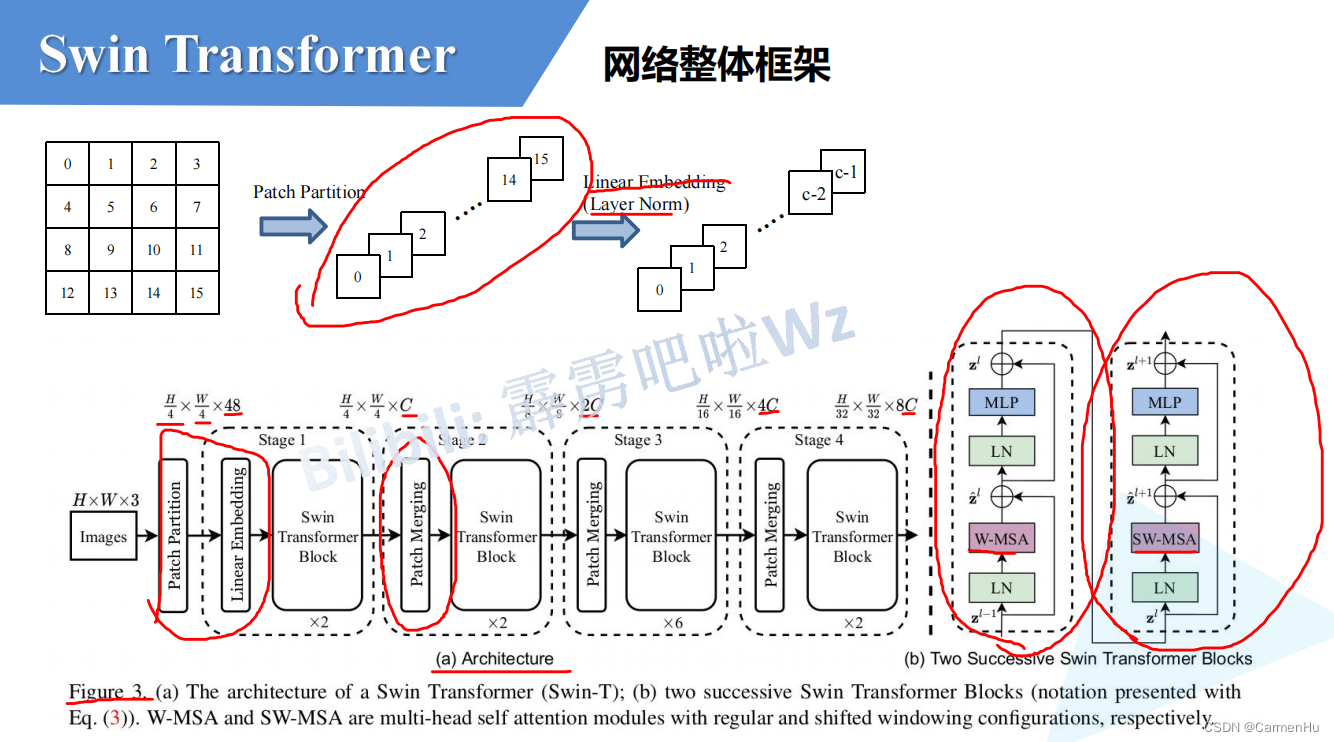

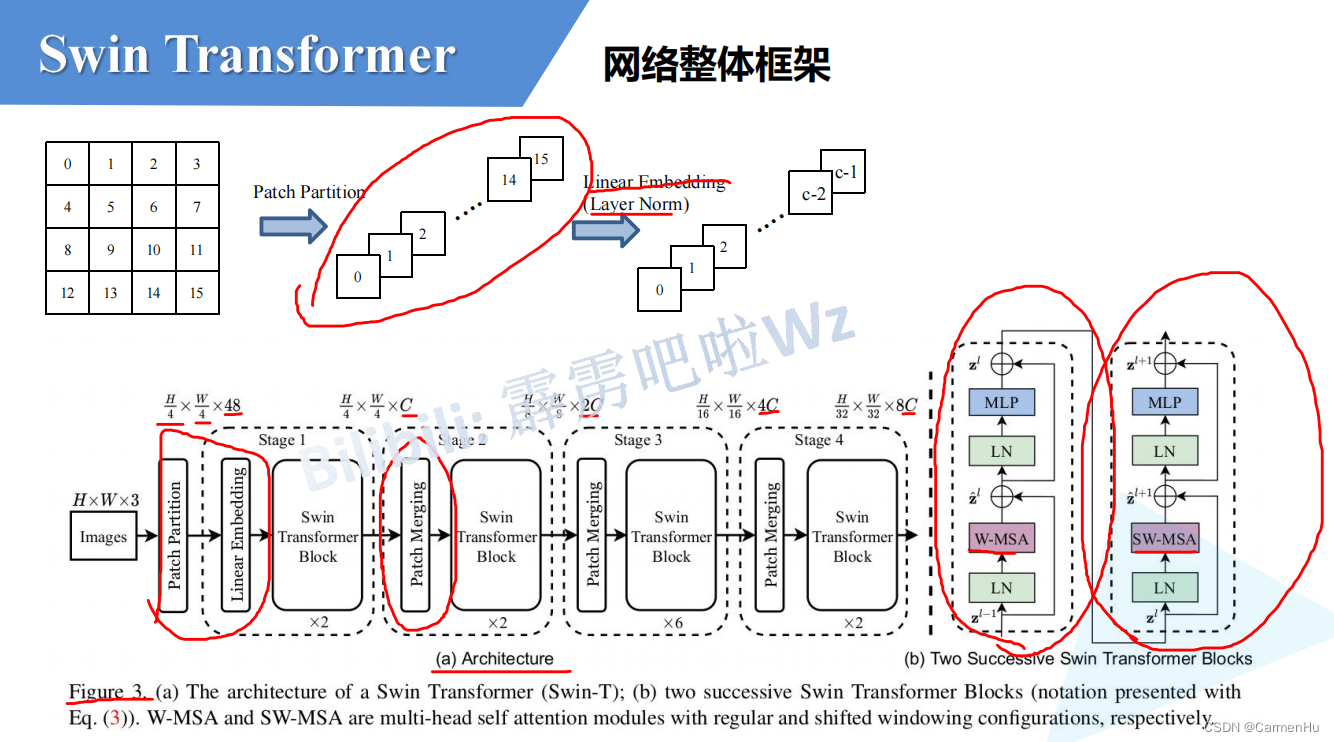

一、网络框架

二、Patch Merging

图像长和宽减半,通道数增加一倍

三、W-MSA

目的:减少计算量

缺点:窗口之间无法进行信息交互

四、SW-MSA

目的:实现不同window之间的信息交互

为了不增加计算量,移动window并增加Mask-MSA

计算完后将数据移动到原来位置

五、Relative position bias

bias才是Attention中B的数值,我们训练的是bias table中的参数

六、模型详细配置参数

一、网络框架

二、Patch Merging

图像长和宽减半,通道数增加一倍

三、W-MSA

目的:减少计算量

缺点:窗口之间无法进行信息交互

四、SW-MSA

目的:实现不同window之间的信息交互

为了不增加计算量,移动window并增加Mask-MSA

计算完后将数据移动到原来位置

五、Relative position bias

bias才是Attention中B的数值,我们训练的是bias table中的参数

六、模型详细配置参数

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.mzph.cn/news/748928.shtml

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈email:809451989@qq.com,一经查实,立即删除!