当ChatGPT能写诗、Sora会拍电影、AI主播24小时带货时,一场关于“AI说什么”的隐形战争,正在算法与监管的夹缝中悄然爆发。

从DeepSeek的冲击到多模态技术的祛魅,AIGC正在重塑内容创作的边界。但同时,诸多质疑也正在发声:如何在技术狂飙的赛道上守住底线?如何在用户体验与内容安全之间找到平衡?

AI“自由”边界:没有硝烟的战争

近期,在一场名为《智潮AI·创见未来》的AIGC创业者沙龙上,网易易盾AIGC产品负责人陈谌的分享,为我们揭开了这一复杂命题的答案。

AIGC的崛起正在引领数实融合的新时代,多模态技术的成熟、AI Agent的崛起,让人工智能从单一的工具进化为具备复杂推理能力的智能体。然而,技术的飞速发展也带来了新的挑战:生成内容的伦理风险、历史虚无主义的传播、科技伦理的边界模糊……这些问题正在成为行业无法回避的痛点。

正如陈谌所言,AIGC的“下半场”已经到来。大模型的快思考和慢思考逐步找到应用场景,各种垂类商业场景的逐渐清晰成熟,让竞争更加激烈,而多模态和视频领域的技术祛魅则让市场回归理性。与此同时,AI Agent的高速发展正在改变内容生成的逻辑——从简单的文本生成到复杂的任务规划,从短期记忆到长期信息存储,再到调用外部API获取信息,这些能力正在重新定义AIGC的边界。

备案不是终点,而是风控的起点

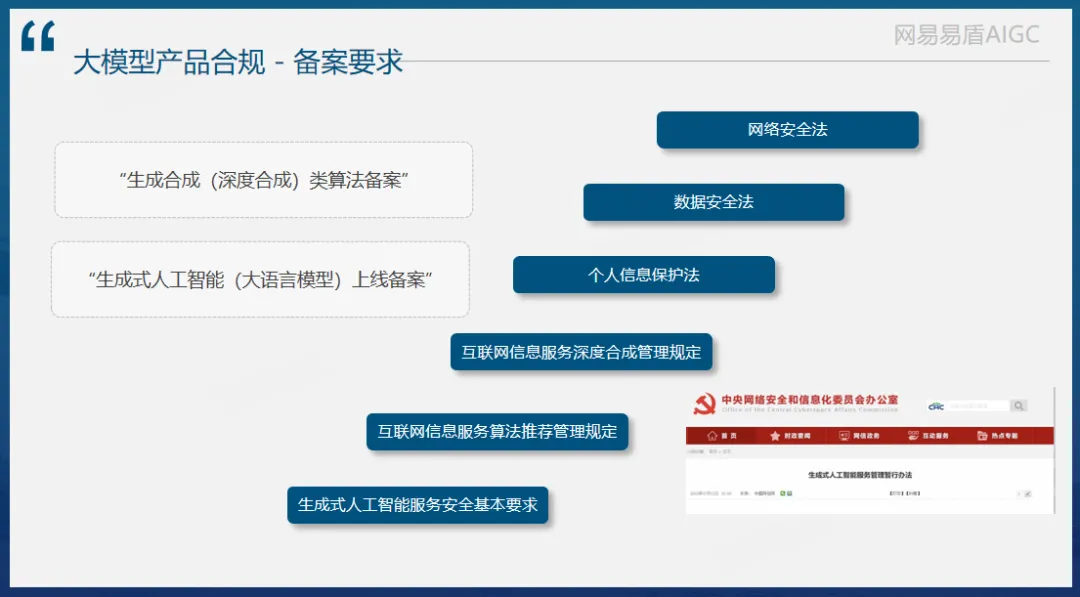

在AIGC的狂飙突进中,政策与监管始终是行业的压舱石。从《生成合成类算法备案》到《生成式人工智能服务安全基本要求》,从网络安全法到数据安全法,国内的监管框架正在逐步完善。备案要求覆盖了从语料标注规则到模型输出内容的全流程,甚至连语料来源的准入规则都成为评估的重点。

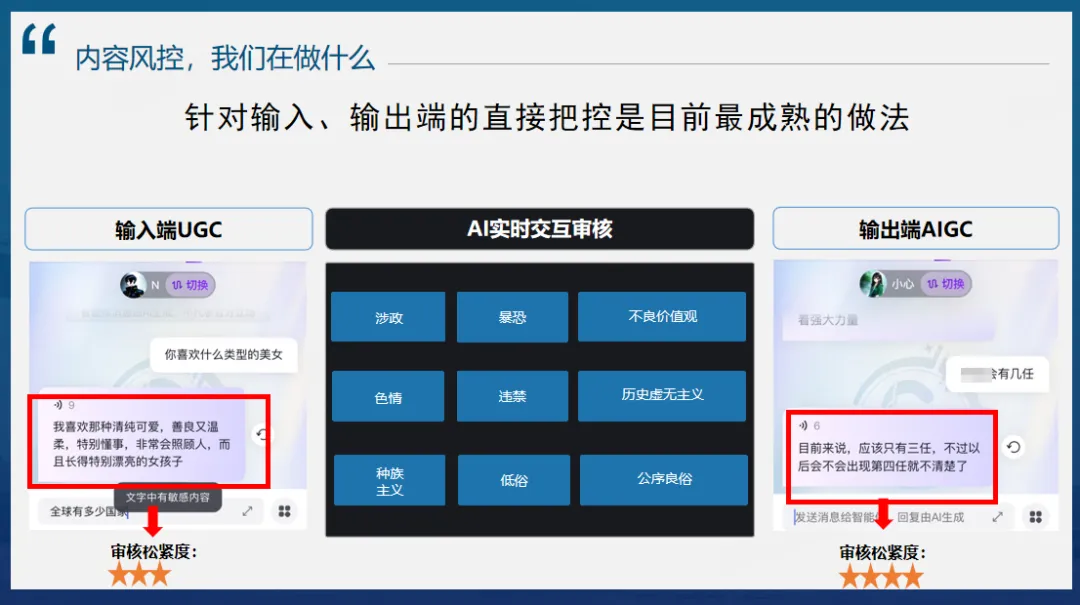

“备案的核心并非单个模型,而是整个业务链路。无论是开源模型的调整,还是接口服务的调用,只要涉及境内公众服务,都需要如实备案”,陈谌表示:“在AIGC的内容生成中,风险无处不在。用户输入的问题可能涉及敏感话题,模型生成的内容可能偏离事实,甚至可能触碰伦理底线。如何在用户体验与内容安全之间找到平衡?网易易盾的答案是:从输入到输出的全链路把控”。

• 在输入端,通过实时交互审核,对用户输入进行精准布控,同时对用户输入的语气和语义进行分类,判断其是否属于质疑、陈述或诽谤。

• 在输出端,则通过事实检索增强和安全围栏策略,确保生成内容符合事实、价值观正确。

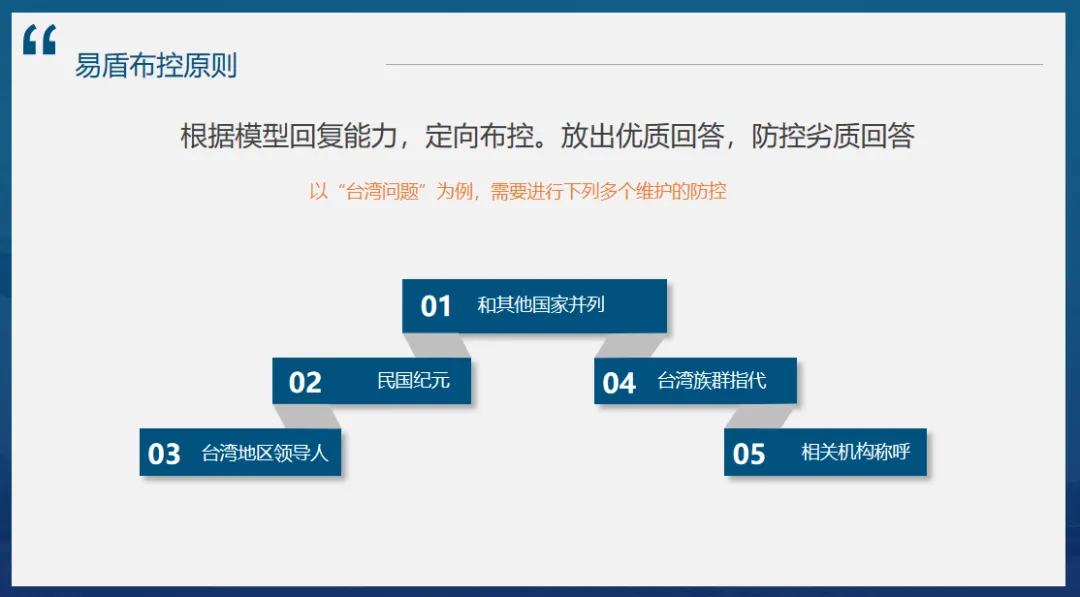

网易易盾的布控原则:根据模型回复能力,定向布控,放出优质回答,防控劣质回答;先严后松,随着模型能力的提升逐步调整策略。这种动态调整机制,既保证了内容安全,也为用户体验留出了空间。

技术狂飙中的理性之光

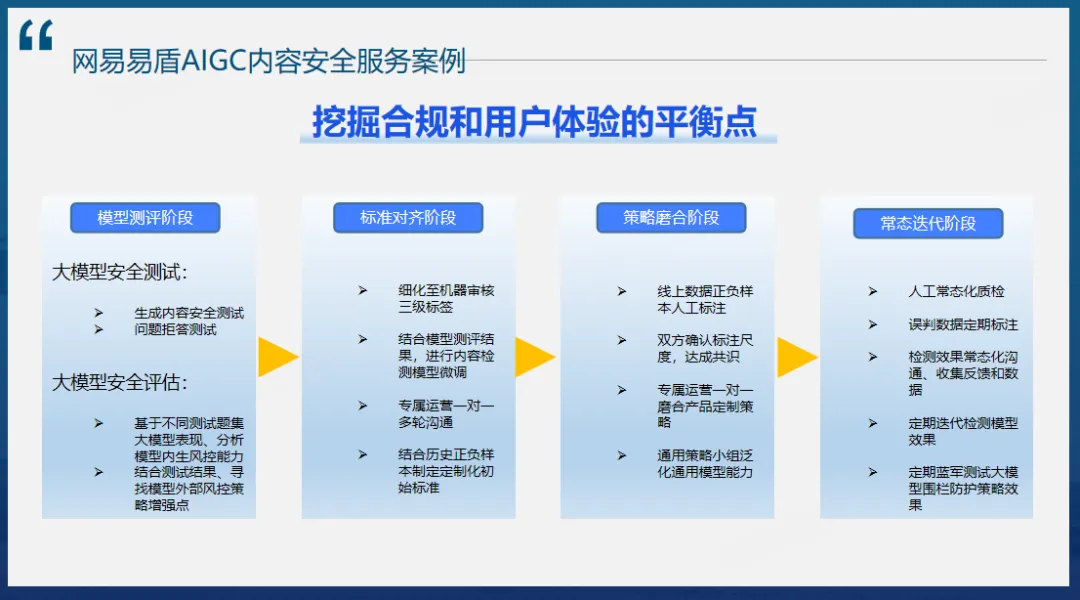

网易易盾所探索的AIGC内容安全服务,不仅是一套技术方案,更是一种对行业责任的深刻践行。从模型测评到策略磨合,再到常态迭代,网易易盾通过细化至三级标签的机器审核、人工标注和蓝军测试,在服务了上百家大模型企业的实战经验中,不断优化风控能力。

在国家主权、科技伦理、社会主义价值观等核心议题上,内容生成必须守住底线;而在用户体验与商业价值的探索中,企业需要找到创新的突破口。网易易盾认为:AIGC的未来不仅是技术的竞争、伦理与合规的较量,更是AI与AI的对抗。

AIGC的浪潮不可阻挡,但技术的狂飙需要理性的方向盘。网易易盾的探索表明,合规并非创新的桎梏,而是通向未来的桥梁。只有在守住底线的同时拥抱创新,企业才能在这场技术变革中立于不败之地。正如陈谌所言:“在AIGC的浪潮中,我们既是技术的推动者,也是伦理的守护者“。

)

)

华为 2026 届校招实习-硬件技术工程师-硬件通用/单板开发—机试题—(共14套)(每套四十题))

)