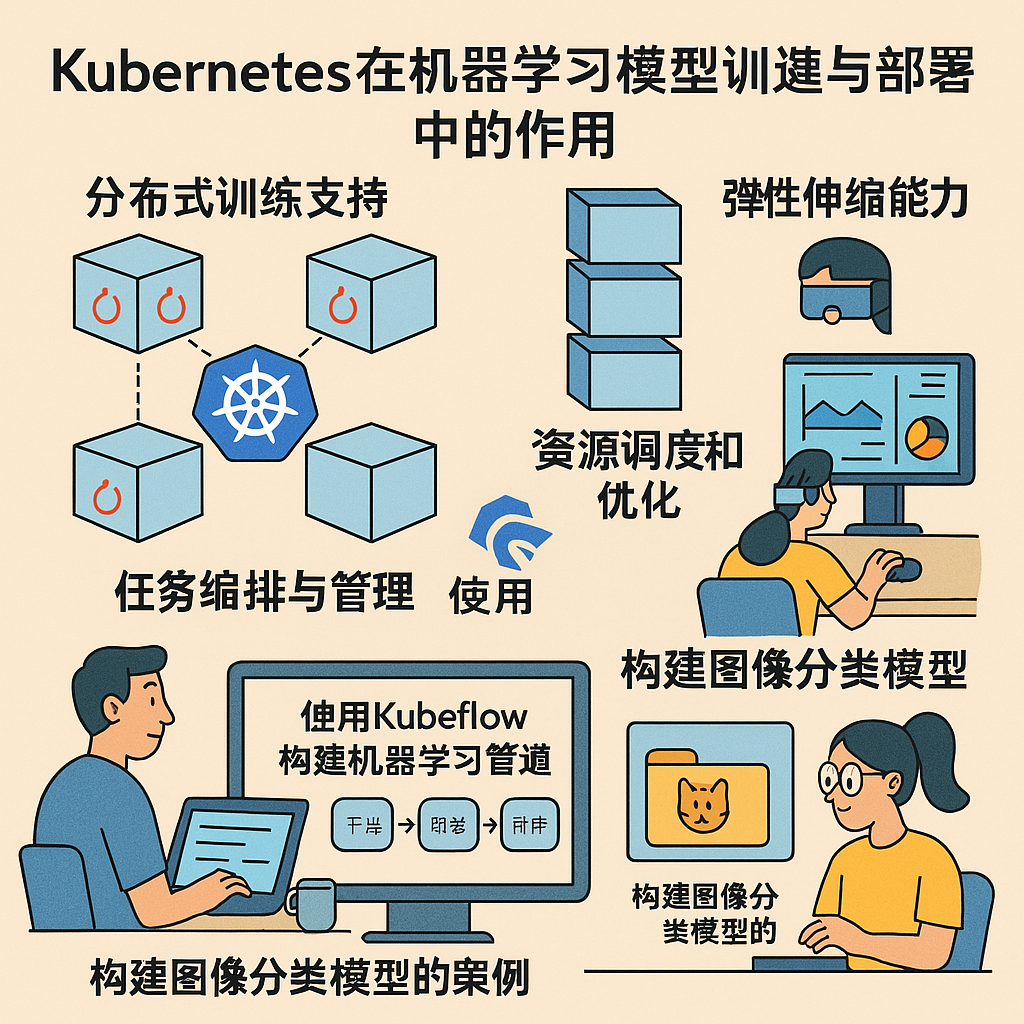

一、Kubernetes在机器学习模型训练与部署中的作用

Kubernetes作为一个强大的容器编排平台,为机器学习模型的训练与部署提供了以下核心支持:

- 分布式训练支持:Kubernetes能够自动化部署和管理PyTorch等机器学习框架的分布式训练任务。通过利用多节点集群的计算资源,Kubernetes可以显著加速模型的训练过程,提高资源利用率。

- 弹性伸缩能力:根据训练任务的负载情况,Kubernetes可以自动扩展或收缩容器实例的数量。这确保了资源的高效利用,同时避免了资源浪费。

- 任务编排与管理:Kubernetes支持定义任务依赖关系和执行顺序,可以自动化执行复杂的数据处理和机器学习流程。这包括数据清洗、模型训练、评估和部署等各个环节。

- 资源调度与优化:Kubernetes能够根据资源需求(如CPU、内存、GPU)自动调度和分配计算资源,确保训练任务的高效运行。同时,它还可以优化资源使用,避免资源冲突和浪费。

二、Kubeflow的功能与优势

Kubeflow是一个专门为Kubernetes上的机器学习模型设计的工具包,它简化了机器学习管道的构建和管理。Kubeflow的主要功能和优势包括:

- 端到端机器学习管道:Kubeflow提供了一个端到端的平台,用于编排可重复使用的机器学习工作流。这包括数据准备、模型训练、评估和部署等各个环节,实现了全流程的自动化。

- 可重用组件:Kubeflow允许用户将机器学习工作流拆分为可重用的组件。这些组件可以是数据预处理、特征工程、模型训练或评估等任何步骤。通过组件化,用户可以轻松构建复杂的工作流,并在不同的项目中重用这些组件。

- 可视化工作流:Kubeflow提供了一个直观的用户界面,允许用户以图形化的方式设计和监控工作流。这使得团队成员可以轻松理解工作流的结构和进度,提高了协作效率。

- 实验跟踪与管理:Kubeflow内置了实验跟踪功能,允许用户比较不同运行的结果,记录参数和指标。这有助于用户更好地管理机器学习实验,提高实验的可再现性和可靠性。

- 灵活的部署选项:Kubeflow可以作为Kubeflow平台的一部分安装,也可以作为独立服务部署。这为用户提供了灵活的部署选择,满足了不同场景的需求。

三、使用Kubeflow构建端到端机器学习管道的实际案例

以构建一个图像分类模型的端到端工作流为例,使用Kubeflow Pipelines可以轻松地实现以下步骤:

- 定义组件:首先,定义工作流中的各个组件,如数据下载、预处理、模型训练、评估和部署等。每个组件通常是一个独立的任务,可以单独开发和测试。

- 构建管道:使用定义好的组件构建完整的管道。管道定义了组件之间的依赖关系和数据流,实现了全流程的自动化。

- 编译和上传:将定义好的管道编译成Kubeflow Pipelines可以理解的格式,并上传到Kubeflow Pipelines服务器。

- 运行和监控:通过Kubeflow Pipelines的UI或API运行管道,并监控其进度和结果。用户可以实时查看每个步骤的执行状态、日志和模型训练过程。

四、PyTorch分布式训练在Kubernetes上的实现

在Kubernetes上部署PyTorch实现分布式训练,可以使用Kubeflow提供的PytorchJob资源。PytorchJob是一种原生Kubernetes资源类型,用于在Kubernetes集群中部署和管理PyTorch训练任务。以下是一个简单的PytorchJob YAML文件示例:

# apiVersion 指定了要创建的 Kubernetes 对象的 API 版本。

# 对于 Kubeflow 的 PyTorchJob,通常使用 kubeflow.org/v1。

apiVersion: kubeflow.org/v1

# kind 指定了要创建的 Kubernetes 对象的类型。

# 这里我们创建的是一个 PyTorchJob。

kind: PyTorchJob

# metadata 包含了关于该对象的元数据,例如名称和命名空间。

metadata:# name 是此 PyTorchJob 在指定命名空间内的唯一标识符。name: pytorch-job-example# namespace 指定了此 Job 将在哪个 Kubernetes 命名空间中创建和运行。# 如果省略,则使用默认的命名空间(通常是 'default')。namespace: default

# spec 定义了 PyTorchJob 的期望状态和配置。

spec:# cleanPodPolicy 定义了 Job 完成(成功或失败)后如何处理其创建的 Pod。# 'None' 表示 Job 完成后保留 Pod,便于调试和查看日志。# 其他可选值包括 'Running'(只删除正在运行的 Pod)和 'All'(删除所有 Pod)。cleanPodPolicy: None# pytorchReplicaSpecs 定义了分布式 PyTorch 训练中不同角色的配置。# 对于 PyTorchJob,通常需要定义 'Master' 和 'Worker' 角色。pytorchReplicaSpecs:# Master 定义了 Master 角色的配置。Master 通常负责协调训练过程。Master:# replicas 指定了要创建的 Master Pod 的数量。对于 PyTorch 分布式训练,通常只需要一个 Master。replicas: 1# restartPolicy 定义了当 Pod 中的容器退出时,Kubernetes 应采取的操作。# 'OnFailure' 表示只有在容器以非零状态码退出(即失败)时才尝试重启容器。# 其他常用值: 'Never'(从不重启),'Always'(总是重启)。restartPolicy: OnFailure# template 定义了用于创建 Master Pod 的 Pod 模板。这是一个标准的 Kubernetes PodTemplateSpec。template:# spec 定义了 Pod 的详细规格。spec:# containers 定义了在此 Pod 中运行的容器列表。containers:# name 是容器在此 Pod 内的唯一名称。- name: pytorch# image 指定了用于此容器的 Docker 镜像。# 这里使用了包含 PyTorch 1.9.0、CUDA 11.1 和 cuDNN 8 的官方镜像。image: pytorch/pytorch:1.9.0-cuda11.1-cudnn8-runtime# command 指定了容器启动时要执行的主命令。# 这会覆盖 Docker 镜像中定义的默认 ENTRYPOINT。command: ["python", "/workspace/train.py"]# args 是传递给上面 command 的参数列表。# 这里传递了 '--epochs' 参数,值为 '10'。args: ["--epochs", "10"]# resources 定义了容器所需的计算资源(CPU、内存、GPU 等)以及限制。resources:# limits 定义了容器可以使用的资源上限。limits:# nvidia.com/gpu 指定了需要分配给此容器的 NVIDIA GPU 数量。# 这里请求了 1 个 GPU。节点必须有可用的 GPU 资源并且配置了 NVIDIA device plugin。nvidia.com/gpu: 1# Worker 定义了 Worker 角色的配置。Worker 通常执行实际的训练计算任务。Worker:# replicas 指定了要创建的 Worker Pod 的数量。# 这里配置了 2 个 Worker Pod,与 Master Pod 一起构成一个包含 3 个节点的分布式训练集群。replicas: 2# restartPolicy 定义了 Worker Pod 的重启策略,与 Master 类似。restartPolicy: OnFailure# template 定义了用于创建 Worker Pod 的 Pod 模板。template:# spec 定义了 Worker Pod 的详细规格。spec:# containers 定义了在 Worker Pod 中运行的容器列表。containers:# name 是 Worker 容器的名称。- name: pytorch# image 指定了 Worker 容器使用的 Docker 镜像。# 通常 Worker 和 Master 使用相同的镜像以确保环境一致。image: pytorch/pytorch:1.9.0-cuda11.1-cudnn8-runtime# command 指定了 Worker 容器启动时要执行的主命令。# 这通常与 Master 的命令相同,因为训练脚本内部会根据环境变量区分角色。command: ["python", "/workspace/train.py"]# args 是传递给 Worker 容器 command 的参数。args: ["--epochs", "10"]# resources 定义了 Worker 容器的资源请求和限制。resources:# limits 定义了 Worker 容器的资源上限。limits:# nvidia.com/gpu 指定了需要分配给每个 Worker 容器的 GPU 数量。# 这里每个 Worker 也请求了 1 个 GPU。nvidia.com/gpu: 1在这个示例中,定义了一个包含1个Master节点和2个Worker节点的PyTorch分布式训练任务。Master节点负责协调任务和数据分发,Worker节点负责执行训练任务。通过Kubernetes的自动化部署和管理,可以轻松地实现PyTorch模型的分布式训练。

总结来看,使用Kubernetes部署PyTorch框架实现分布式训练和部署,并结合Kubeflow构建端到端的机器学习管道,是一个高效、可靠且可扩展的解决方案。它充分利用了Kubernetes的容器编排能力和Kubeflow的机器学习工具链优势,为机器学习模型的训练与部署提供了全流程的自动化支持。

![[ctfshow web入门] web32](http://pic.xiahunao.cn/[ctfshow web入门] web32)