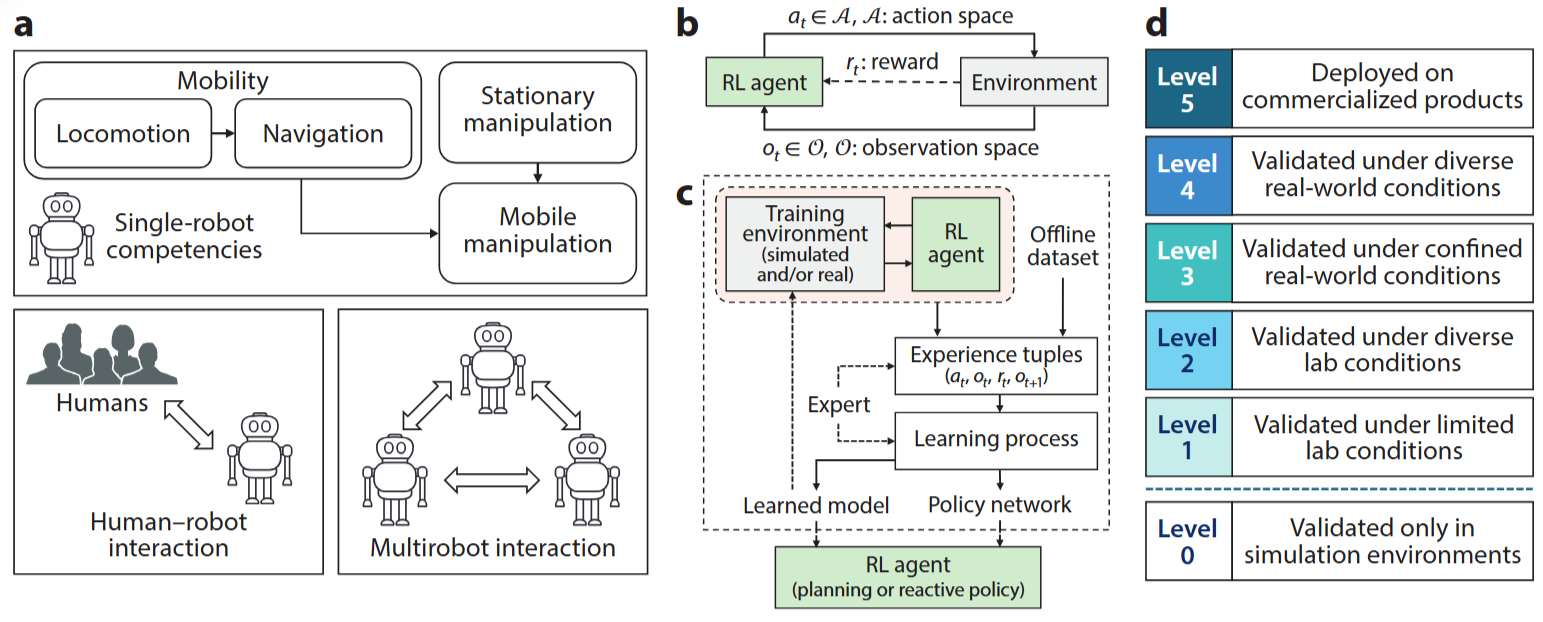

a. 机器人能力

1 单机器人能力(Single-robot competencies)

- 运动能力(Mobility)

- 行走(Locomotion)

- 导航(Navigation)

- 操作能力(Manipulation)

- 静态操作(Stationary manipulation)

- 移动操作(Mobile manipulation_MoMa):将运动与操作结合

2 人机交互(Human–robot interaction):机器人与人类实时协作、交流

3 多机器人交互(Multirobot interaction):多个机器人之间的协同

b. 问题建模(Problem Formulation)

- 强化学习基本模型的要素:

- 状态空间

- 动作空间

- 奖励函数

- 智能体与环境的交互过程

c. 解决策略(Solution Approach)

- 训练方式:

- 在线训练(环境实时交互)

- 离线数据集(offline dataset)

- 专家演示(expert demonstration)

- 学习过程:

- 经验元组

- 学习模型 / 策略网络(learned model / policy network)

- 推理方式:

- 规划式策略(planning policy)

- 反应式策略(reactive policy)

d. 现实世界成熟度(Level of Real-World Success)

| 等级 | 描述 |

|----------|----------------------------------|

| Level 5 | 已部署于商业化产品 |

| Level 4 | 在多种真实条件下验证 |

| Level 3 | 在受限真实条件下验证 |

| Level 2 | 在多样化实验室环境下验证 |

| Level 1 | 在受限实验室环境下验证 |

| Level 0 | 仅在仿真环境中验证 |

Problem Formulation

即如何为所研究的机器人能力构建最优控制策略的数学框架。在机器人任务中,强化学习问题通常被建模为:

- 部分可观马尔可夫决策过程(POMDP):用于单智能体强化学习(single-agent RL);

- 去中心化部分可观马尔可夫过程(Dec-POMDP):用于多智能体强化学习(Multiagent RL, MARL)任务。

a) 动作空间(Action Space)

动作空间定义了智能体的输出控制信号类型。可细分为三类:

- 低层动作(Low-level actions):如关节空间命令或电机控制信号;

- 中层动作(Mid-level actions):如任务空间中的位移或姿态目标;

- 高层动作(High-level actions):如带有时间延展性的任务序列命令或子程序调用(subroutines)。

b) 观测空间(Observation Space)

观测空间描述了智能体对环境状态的感知方式,主要包括:

- 高维观测(High-dimensional observations):如图像、激光雷达点云等原始传感器输入;

- 低维状态向量(Low-dimensional state estimates):如通过估计器或先验模型获得的简化状态表示。

c) 奖励函数(Reward Function)

奖励信号是强化学习的核心驱动因素。根据其反馈密度,可以分为:

- 稀疏奖励(Sparse reward):只有在完成特定目标后才给出奖励;

- 密集奖励(Dense reward):在任务过程中持续给出反馈,以鼓励或惩罚某些行为倾向。

Solution Approach

a) 模拟方式(Simulator Usage)

- Zero-shot sim-to-real transfer:完全基于模拟训练,直接迁移至真实环境,无需真实数据微调;

- Few-shot sim-to-real transfer:模拟训练为主,辅以少量真实环境微调;

- 无模拟器学习(learning directly offline or in the real world):完全在真实世界或离线数据集上进行训练,未使用模拟器。

b) 基于模型学习(Model Learning)

分析是否使用机器人交互数据对系统的**动力学模型(transition dynamics)**进行建模,分为:

- Model-based RL:学习显式模型,用于预测状态转移;

- Model-free RL:不使用或隐式使用环境模型;

- 部分建模(Partial modeling):仅对部分系统或任务阶段建模。

c) 专家示范使用(Expert Usage)

是否引入专家策略(expert policy)或专家数据(如人类演示、oracle 策略)以加速学习过程。方法包括:

- 行为克隆(Behavior Cloning)

- 模仿学习(Imitation Learning)

- 奖励塑形(Reward Shaping)等

d) 策略优化方式(Policy Optimization)

- 规划方法(Planning-based):如模型预测控制(MPC)等;

- 离线RL(Offline RL)

- 异策略RL(Off-policy RL):如 DDPG、TD3、SAC;

- 同策略RL(On-policy RL):如 PPO、TRPO。

e) 策略 / 模型表示方式(Policy/Model Representation)

- 多层感知器(Multilayer Perceptrons, MLP)

- 卷积神经网络(Convolutional Neural Networks, CNN)

- 循环神经网络(Recurrent Neural Networks, RNN)

- 图神经网络、Transformer等新型架构

图源:Deep Reinforcement Learning for Robotics: A Survey of Real-World Successes,Chen Tang1

案例教程:最新抖音视频文案提取方法替代方案,音频视频提取文案插件制作,手把手教学,完全免费教程)

)

![[ctfshow web入门] web6](http://pic.xiahunao.cn/[ctfshow web入门] web6)

快速进入深度学习pytorch环境)