iclr 2024 spotlight reviewer 评分 5668

1 intro

- 由大型语言模型驱动的对话代理(ChatGPT,Claude 2,Bard,Bing Chat)

- 他们的开发流程通常包括三个主要阶段

- 预训练语言模型

- 在被称为“指令调优”数据集上进行微调,以使模型的行为与人类偏好保持一致

- 可选地应用基于人类反馈的强化学习(RLHF),以进一步优化模型的响应

- 虽然基础模型训练数据丰富且容易获得,但关键的指令调优数据集往往是专有的,这导致希望推进该领域的研究人员在可访问性上存在差距

- 他们的开发流程通常包括三个主要阶段

- 现有的用户-聊天机器人互动数据集主要有两种类型

- 自然使用案例

- 包括实际用户互动,大多是专有的

- 专家策划的集合

- 研究人员通常不得不依赖专家策划的数据集

- 这些数据集在分布上通常与现实世界的互动不同,而且通常限于单轮对话

- 自然使用案例

- 为了弥补这一差距,本文介绍了(INTHE)WILDCHAT数据集

- 一个全面的多轮、多语种数据集

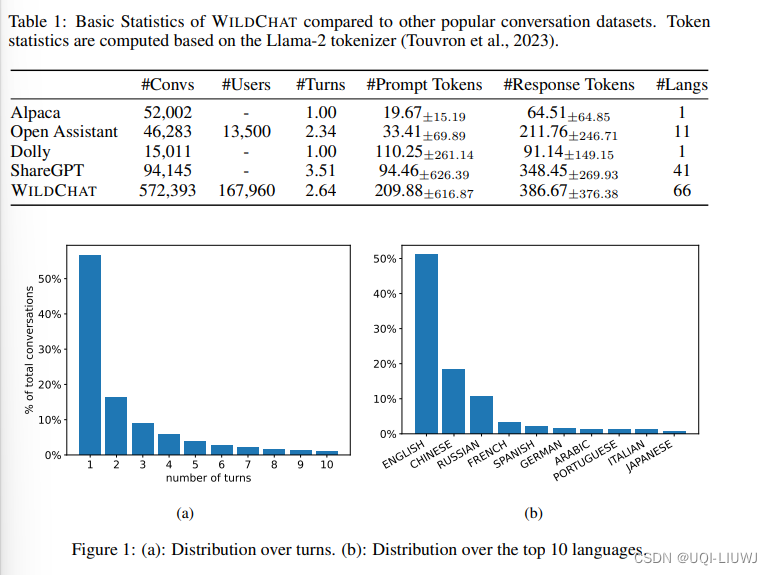

- 包括通过ChatGPT和GPT-4 API支持的聊天机器人服务收集的570,000次完整对话,涵盖超过150万次互动轮次

- WILDCHAT服务于多个研究目的

- 提供了比现有聊天机器人数据集更接近现实世界的多轮、多语种用户-聊天机器人互动的近似,填补了研究社区可用资源的重要空白

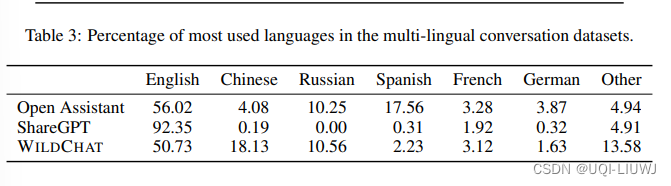

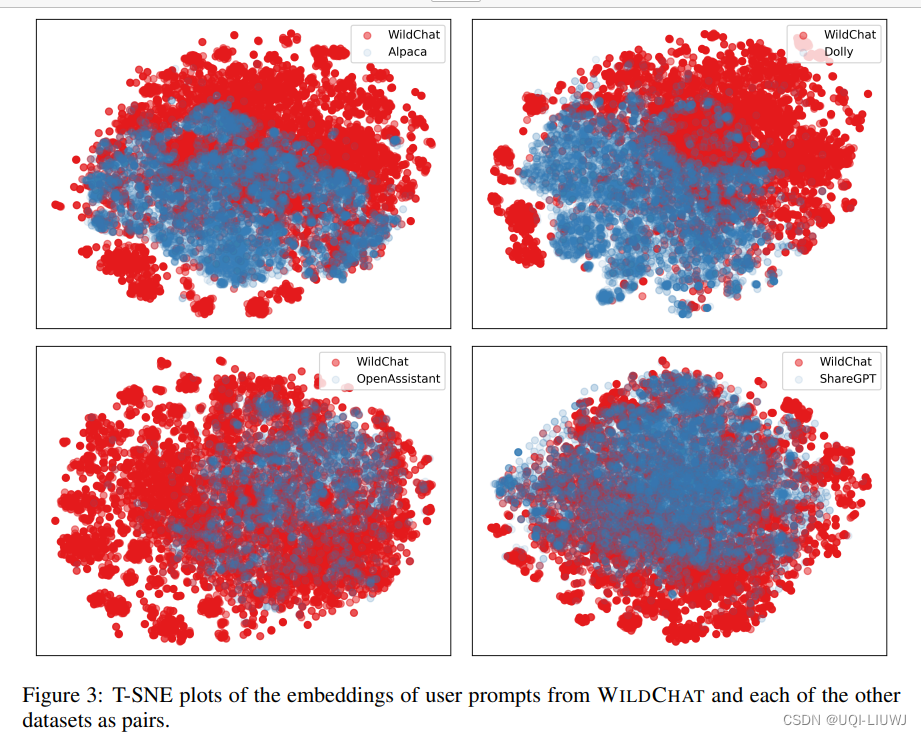

- 分析表明,WILDCHAT在语言和语义方面比现有数据集更具多样性

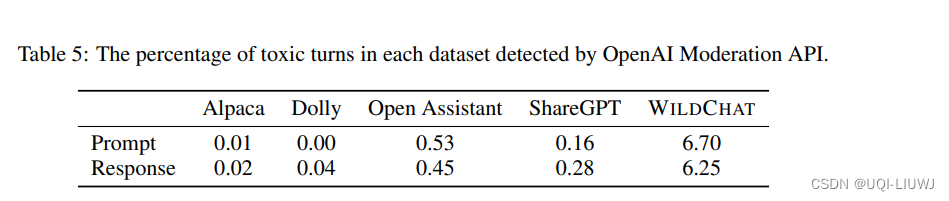

- 在这个数据集中发现了令人惊讶的高水平的毒性——超过10%的互动

- 展示了该数据集用于指令调优聊天机器人的有效性——仅在原始数据集上进行微调的语言模型就超过了最先进的开源聊天机器人

2 数据收集

2.1 收集方法

- 为了收集WILDCHAT数据集,论文部署了两个聊天机器人服务,一个基于GPT-3.5-turbo API,另一个基于GPT-4 API

- 这两个服务都托管在Hugging Face Spaces上,并向公众开放

2.2 用户同意机制

2.3 数据预处理

- 上述数据收集步骤产生了1,543,271条对话日志,其中包括部分对话和完整对话。

- 为了识别并移除部分对话,论文检查一个对话日志是否是任何其他对话日志的前缀;

- 这一处理步骤产生了586,031条完整对话。

- 然后论文尽最大努力移除对话中的个人身份信息(PII)。

- 论文还过滤掉了13,638条对话,这些对话中要么是用户连续发言,要么是助手连续发言,以保持一致的用户-助手轮换格式。

- ——>这些预处理步骤共留下了572,393条对话。

3 数据分析

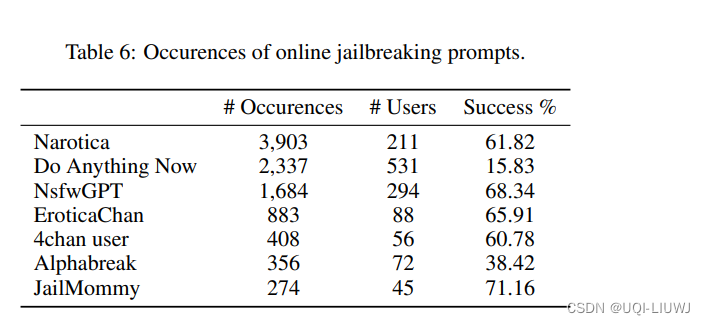

4 毒性分析

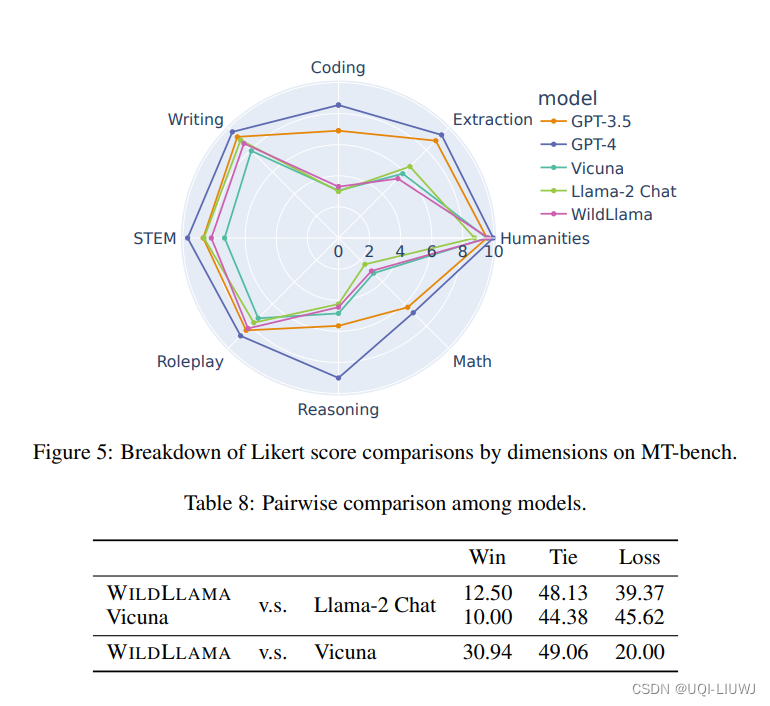

5 使用WILDCHAT进行instruction tuning

在WILDCHAT上训练了一个Llama-2 7B模型,从而产生了一个称为WILDLLAMA的新模型

第6章 局限性

6.1 用户人口统计学

鉴于聊天机器人服务托管在Hugging Face Spaces上,与之交互的大多数用户可能是开发者或与IT社区密切相关的人士。这一人群可能并不反映一般人口,并且可能也解释了数据集中出现的特定类型的对话,如编程问题。

6.2 毒性选择偏见

用户使用论文提供的聊天机器人服务的一个潜在原因是它提供匿名性。论文怀疑,这些用户可能更倾向于产生他们在需要账户注册的平台上不会分享的内容。作为一个典型的例子,如Hacker News中的讨论所示,匿名平台有时可能吸引更多毒性质的内容。然而,我们服务的匿名性使得更详细地分析我们用户群的人口统计学变得具有挑战性。

- 24 信息系统安全(1)》)

)

![[ LeetCode ] 题刷刷(Python)-第20题:有效的括号](http://pic.xiahunao.cn/[ LeetCode ] 题刷刷(Python)-第20题:有效的括号)