简介

VCoder的一个视觉编码器,能够帮助MLLM更好地理解和分析图像内容。提高模型在识别图像中的对象、理解图像场景方面的能力。

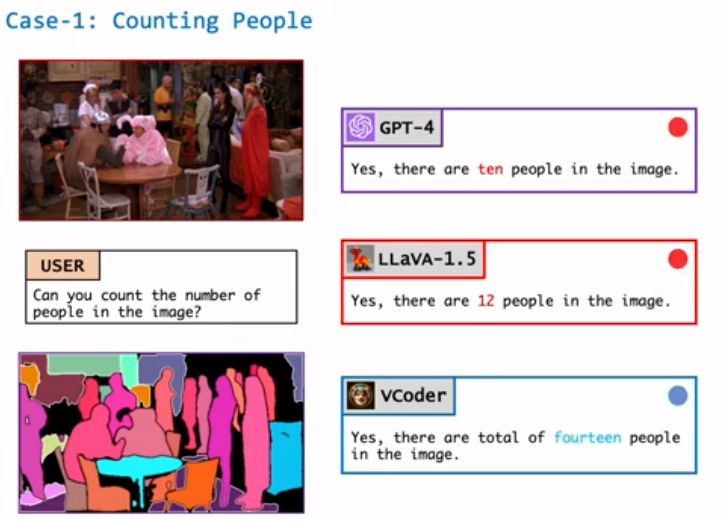

它可以帮助模型显示图片中不同物体的轮廓或深度图(显示物体距离相机的远近)。还能更准确的理解图片中的物体是什么,甚至能数出图片中有多少人。

功能介绍

1、增强视觉感知能力:VCoder通过提供额外的视觉编码器,帮助MLLM更好地理解和分析图像内容。

2、处理特殊类型的图像:VCoder能够处理分割图和深度图等特殊类型的图像。分割图可以帮助模型识别和理解图像中不同物体的边界和形状,而深度图则提供了物体距离相机远近的信息。

3、改善对象感知任务:VCoder通过提供额外的感知模态输入(如分割图或深度图)显著提高了MLLMs的对象感知能力。这包括更准确地识别和计数图像中的对象。

实验结果

VCoder与开源的多模态LLMs(如MiniGPT-4、InstructBLIP、LLaVA-1.5和CogVLM)进行了比较,并在COST验证集上进行了测试。

VCoder在对象识别任务中表现最佳,特别是在对象计数和识别方面优于基线模型。

在处理复杂场景中的对象计数和识别任务时,VCoder展示了更高的准确性,尤其是在场景中有许多实体时。

对比GPT-4V:实验表明,GPT-4V在所有对象识别任务中的表现一致,但在与VCoder的比较中,GPT-4V在对象级感知方面落后于VCoder。

项目及演示:https://praeclarumjj3.github.io/vcoder/

论文:https://arxiv.org/abs/2312.14233

GitHub:https://github.com/SHI-Labs/VCoder

在线演示:https://huggingface.co/spaces/shi-labs/VCoder