来源:专知

摘要:本文介绍Arxiv上的《Explanation in Human-AI Systems》,一篇关于可解释机器学习的综述,介绍了可解释机器学习的多学科观点、历史研究、模型、关键点等。

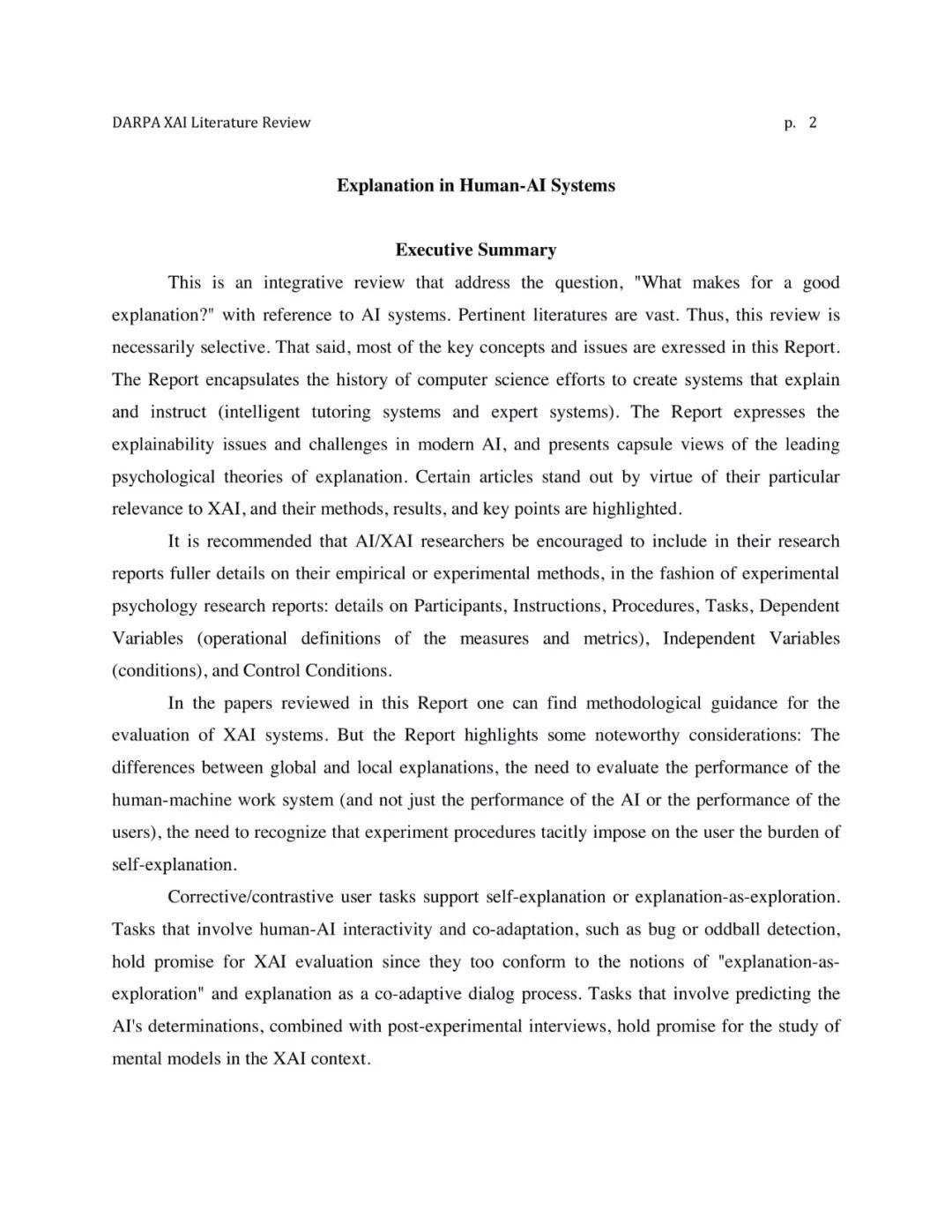

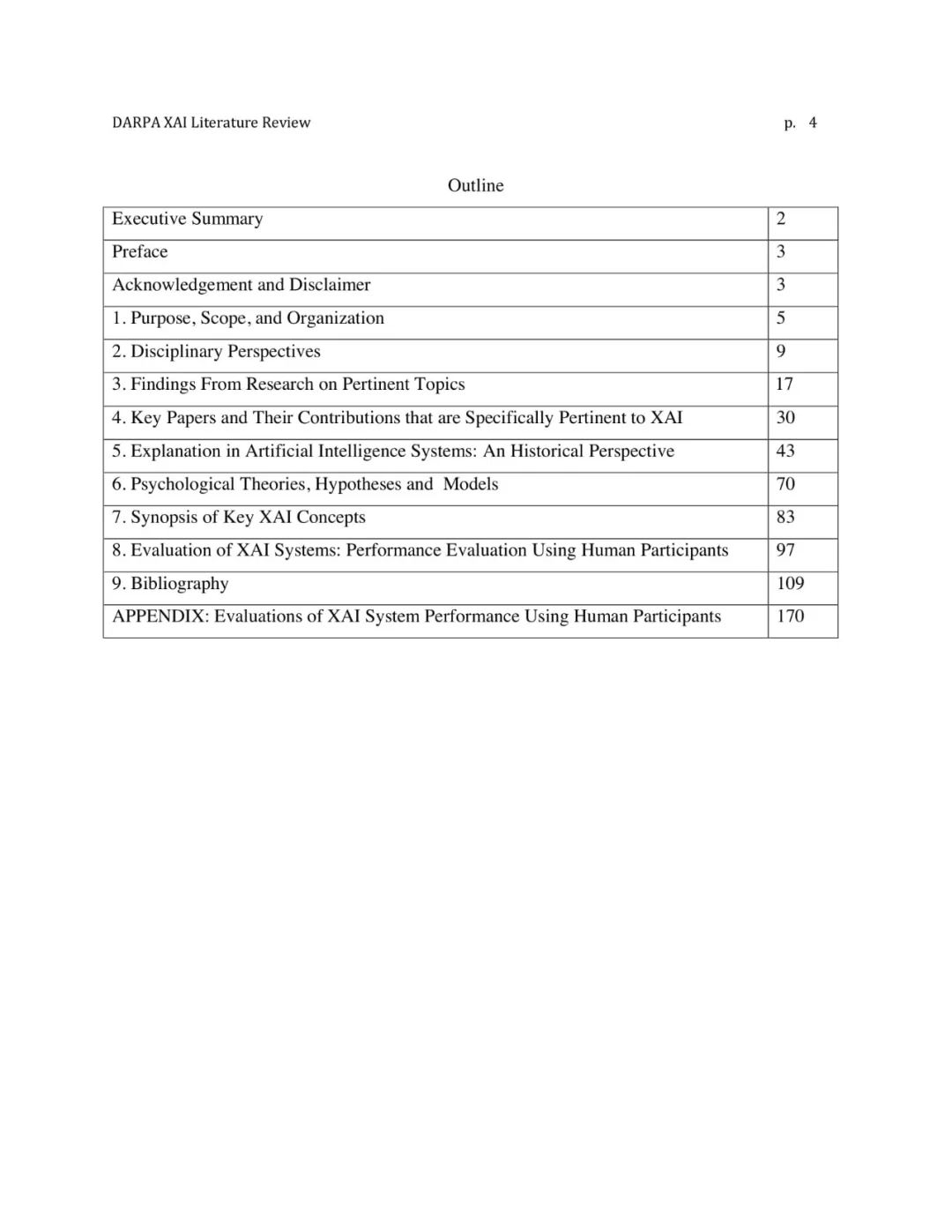

可解释AI是现在正火热的科研和工程问题。Arxiv上一篇《Explanation in Human-AI Systems: A Literature Meta-Review Synopsis of Key Ideas and Publications and Bibliography for Explainable AI》介绍了可解释机器学习的多学科观点、历史研究、模型、关键点等,PDF大概内容组织如下:

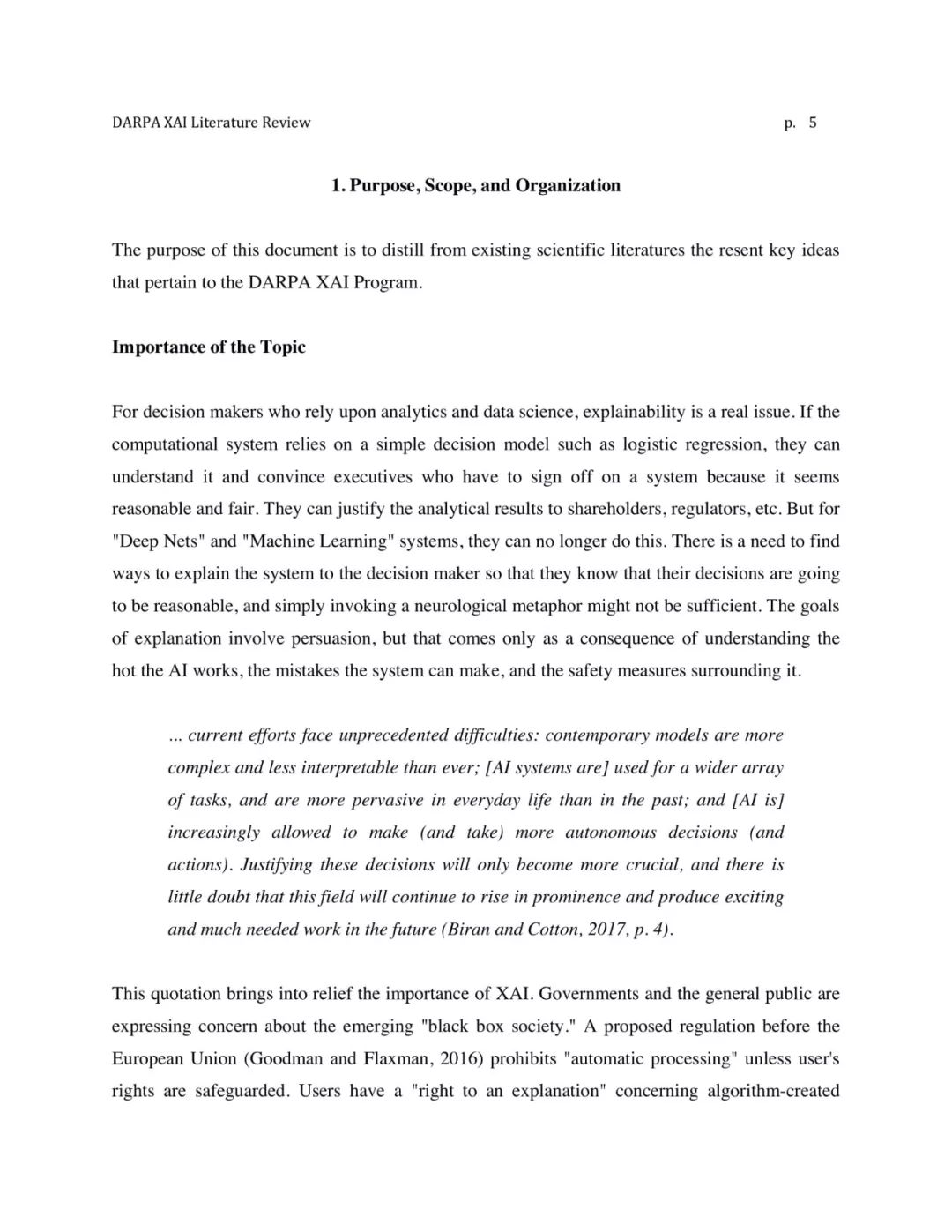

目的、范围和本文组织结构

该主题的重要性

本文的组织结构

多学科观点

哲学

逻辑学观点

机械学观点

统计学观点

相对主义者/实用主义者的观点

心理学

可解释性与心理学

社会心理学

语言心理学

团队科学

其他人类因素、认知系统工程和决策辅助

考虑多学科观点的总结

从研究到相关主题的发现

以前的综述

公平、透明、安全、可靠、道德

信任

因果推理和外展推理

事件和概念的因果和机械推理

类比

理解解释

理解的失败和局限性

复杂系统的理解

反事实和对比推理

个体差异与动机

学习和概念形成

心智模型

前瞻推理与规划

对话式解释

自解释

迁移和泛化

关键论文和它们的贡献

AI系统的可解释性:历史研究的观点

心理理论、假设和模型

分类学

解释性与基础认知过程的关系

好解释的特性

可解释推理的局限和缺点

解释性推理的个体差异

解释的概念模型

心理模型的总结

可解释性AI关键概念的概要

解释的价值

形式和内容

可解释性

解释和证明

候选解释

心智模型

预期和前瞻

全局和本地解释

上下文依赖

对比推理

一致

好的和满意的解释

纠正的解释

信任和可靠

自解释

主动探索作为连续过程

解释作为协作和共同适应过程

测量和评价

可解释性AI系统的评价:人类参与的性能评价

部分PDF内容:

参考链接:

https://arxiv.org/pdf/1806.00069.pdf

未来智能实验室是人工智能学家与科学院相关机构联合成立的人工智能,互联网和脑科学交叉研究机构。

未来智能实验室的主要工作包括:建立AI智能系统智商评测体系,开展世界人工智能智商评测;开展互联网(城市)云脑研究计划,构建互联网(城市)云脑技术和企业图谱,为提升企业,行业与城市的智能水平服务。

如果您对实验室的研究感兴趣,欢迎加入未来智能实验室线上平台。扫描以下二维码或点击本文左下角“阅读原文”

基于MapReduce的ItemBase推荐算法的共现矩阵实现(一))

子类属性生成在自己的一张表中,父类的属性一张表)