大数据文摘出品

来源:deepsense

2013年才举办第一届的ICLR(The International Conference on Learning Representations)发展迅猛,如今已成为是最重要的国际机器学习会议之一,甚至可以和ICML,NeurIPS和CVPR这些老牌著名会议相提并论。

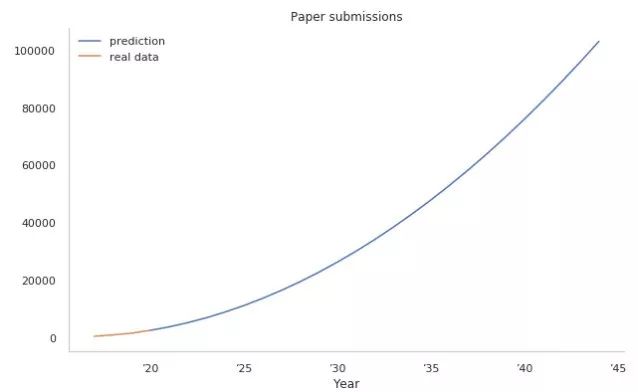

2020年会议定于明年4月26日举行,但是论文提交截止日期已经过去了。这次会议共提交了2585份论文,比2019年多了约1000份论文。

今年提交论文:

https://openreview.net/group?id=ICLR.cc/2020/Conference

按照这个速度估计,24年后,论文提交数量将达到10万份。

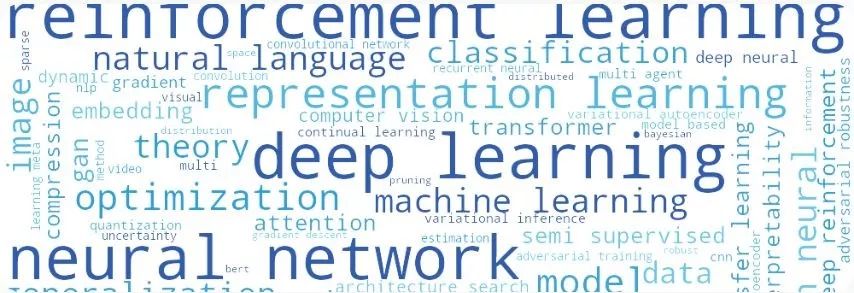

我们分析了过去三年里ICLR所有提交的论文的摘要和关键词,来看看哪些是新的风口,而哪些议题正在消逝。今年,28%的论文使用或声称使用了最新的算法,所以准备接受大量的机器学习知识扑面而来吧!

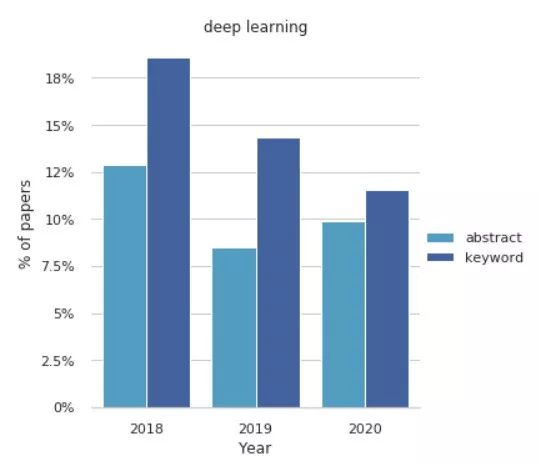

在计算机视觉或自然语言处理中使用深度学习,如今就好像鱼在水中生活一样必要而且自然。深度学习彻底改变了机器学习,它现在几乎存在于机器学习的所有领域,甚至那些不太起眼的地方,比如在时间序列分析或需求预测也可以看到它的身影。

可以说深度学习已经不再是一个前沿话题,而成了机器学习的正常操作。这也解释了为什么在关键词中提及深度学习的数量有所减少——从2018年的19%下降到了2020年的11%。

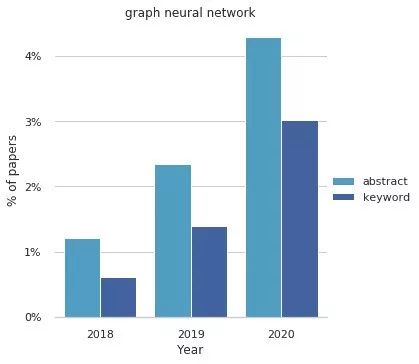

图神经网络(GNN,Graph Neural Networks)是这一年最热门的话题之一。GNN是用于图结构数据的深度学习架构。在医学、社交网络分类和动态交互对象行为建模等应用中,GNN展示了其巨大优势。关于GNN的论文数量的空前增长,从2018年的12篇发展到了2020年的111篇!

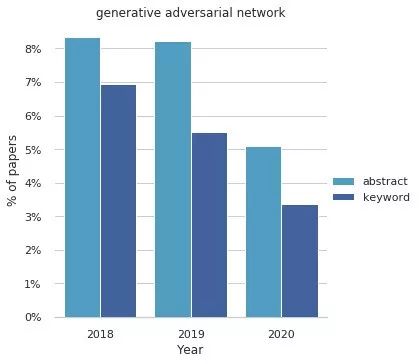

GAN是近些年最流行的话题,但是这个被称之为“近二十年来机器学习领域最酷的想法”似乎已经被利用殆尽。生成对抗网络(GAN,Generative Adversarial Networks)能够模拟任何数据分布,从而创造出令人印象深刻的全新人工图像,但是GAN的火热程度在下降。尽管最近由于deepfake等事件使得GAN一度在媒体报道中十分流行,但是从数据看它确实不如当年了。

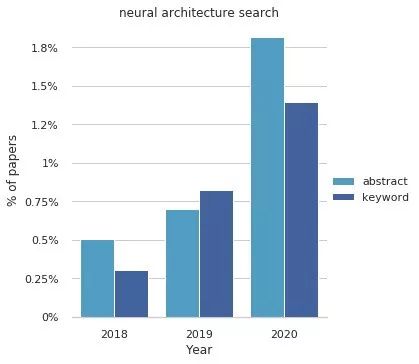

为你的神经网络找到一个合适的架构实在是一件令人头秃的事。但是,不要害怕:神经体系结构搜索(NAS,Neural Architecture Search)来帮你。NAS是一个可以自动构建网络架构的方法。它已经被用于一些最新的算法中用于提升图像分类、对象识别或模型分割的效果。关于NAS的论文从2018年的仅仅5篇增长到2020年的47篇。

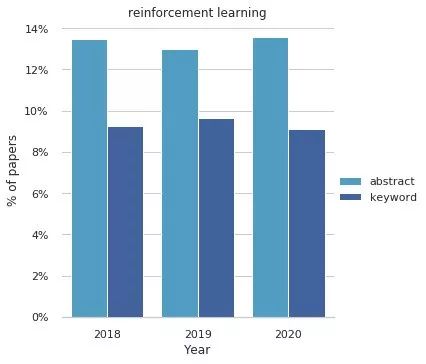

关于强化学习(RL,Reinforcement Learning)的论文占比基本保持不变。人们对这个话题的讨论热度不减——今年主要探讨了强化学习在自动驾驶汽车、AlphaStar在《星际争霸》上的成功以及机器人技术的进步上的应用。强化学习是机器学习的一个稳定分支,而且原因足够充分:人们相信RL会在未来大有可为。

关于强化学习的一篇干货指南:

https://deepsense.ai/what-is-reinforcement-learning-the-complete-guide/

以上只是机器学习发展趋势的一个缩影。明年的风口会在哪里呢?这恐怕即使是最深度的神经网络也难以预测。但是人们对于机器学习的热情仍然是上涨的,这也倒逼着研究人员提出更具创造性的观点。有鉴于此,我们认为未来会有更多创造性的想法涌现出来,即使机器学习的趋势发生了180度的大转弯,也不必感到惊讶。

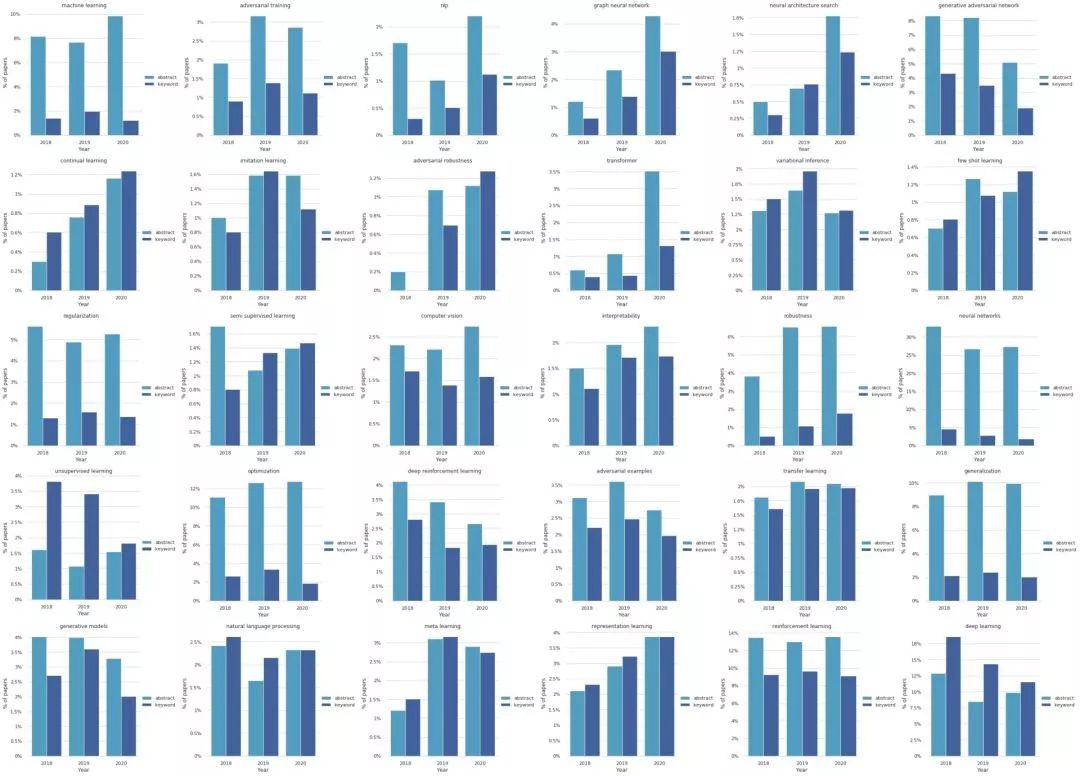

更完整的近三年论文研究趋势见下图:

链接:

https://deepsense.ai/key-findings-from-the-international-conference-on-learning-representations-iclr/

未来智能实验室是人工智能学家与科学院相关机构联合成立的人工智能,互联网和脑科学交叉研究机构。

未来智能实验室的主要工作包括:建立AI智能系统智商评测体系,开展世界人工智能智商评测;开展互联网(城市)云脑研究计划,构建互联网(城市)云脑技术和企业图谱,为提升企业,行业与城市的智能水平服务。

如果您对实验室的研究感兴趣,欢迎加入未来智能实验室线上平台。扫描以下二维码或点击本文左下角“阅读原文”

)

—— pandas 下的常用函数)

![python中x y 1_Python的X[y==1, 0]](http://pic.xiahunao.cn/python中x y 1_Python的X[y==1, 0])

《转载》)