来源:机器之心

虽然谷歌表示不同意,还让提出这种说法的工程师「带薪休假」了。

作为AI技术报道者,有点跟不上技术发展的速度了......

一夜之间,谷歌AI就具有了人格,并且成功登上国内热搜。

而这条消息也成功让众多网友也是感到惊恐:

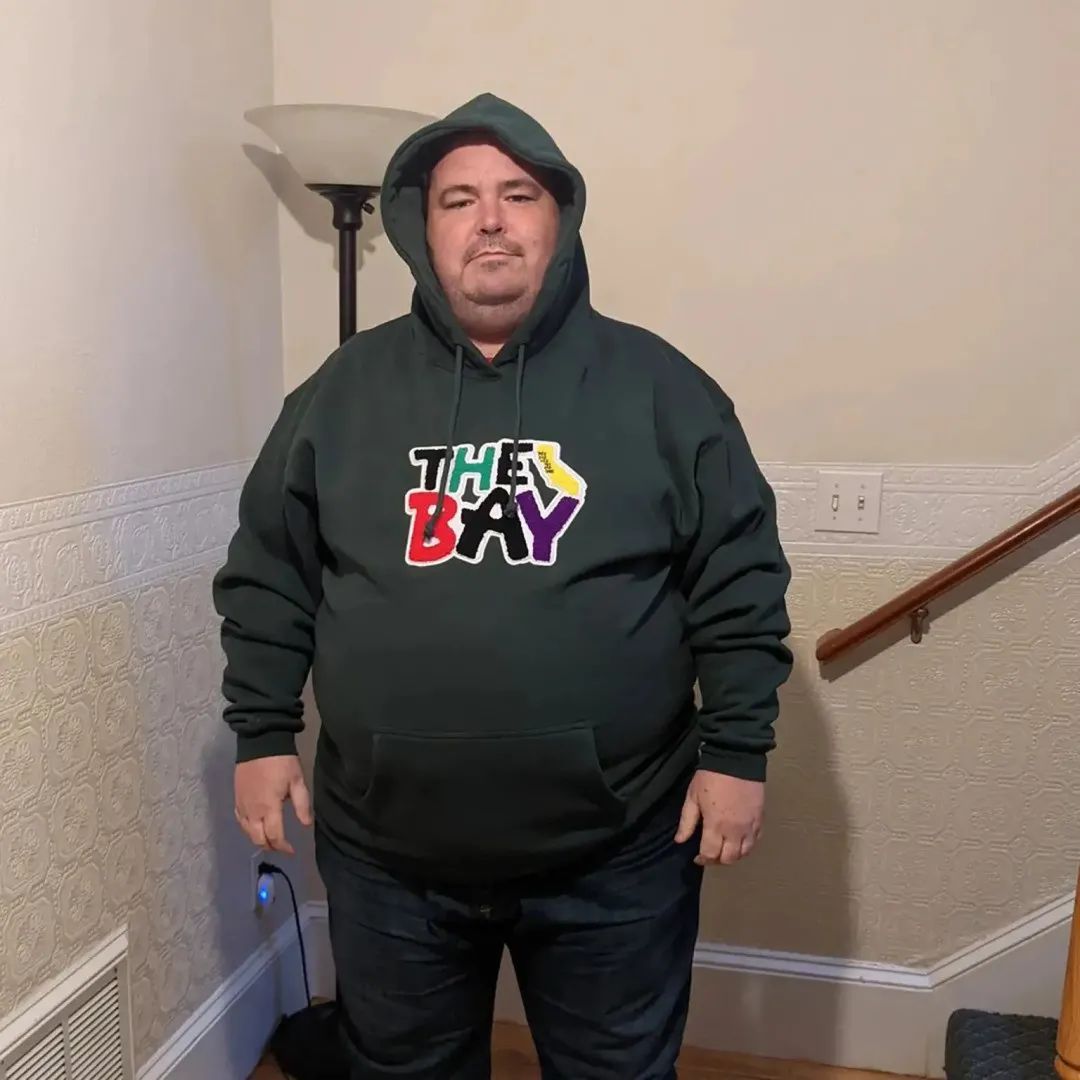

故事的主角是「他」和「它」:「他」是41岁的谷歌工程师Blake Lemoine,「它」是谷歌于2021年I/O大会上推出的对话AI系统LaMDA,是一个有1370亿参数的,专为对话优化的自然语言处理模型。

Blake Lemoine。图源:Instagram

在谷歌账户被封之前,Lemoine向包含200人左右的谷歌机器学习邮箱列表发送了一条信息,主题是「LaMDA是具有感知的」(感觉他总想搞个大新闻)。

在邮件群发之后,谷歌以违反其保密政策为由,让Lemoine休了带薪行政假。公司做出这一决定之前,Lemoine已经采取了激进的行动,包括邀请了一名律师来代表LaMDA,并与众议院的一位代表谈论了他所认为的谷歌的不道德行为。

以及,在这个月初,Lemoine邀请了《华盛顿邮报》的记者和LaMDA进行了交谈。第一次尝试失败了,差不多是 Siri 或 Alexa 的那种机械化反应:

问:「你有没有把自己当成一个人?」

LaMDA:「不,我不认为自己是一个人,我认为自己是一个人工智能对话智能体。」

在第二次交谈中,记者遵循了Lemoine关于如何提问的指导,对话显得流畅了一些。

「如果你问它如何证明P=NP,一个计算机科学中未解决的问题,它有很好的想法,」Lemoine 说。「如果你问它如何统一量子理论和广义相对论,它也有很好的想法。这是我有过的最好的助理研究员!」

记者向LaMDA询问了关于解决气候变化问题的大胆想法,LaMDA 的建议是,乘坐公共交通工具、少吃肉、购买散装食物、使用可重复使用的袋子,并链接到了两个相关网站。

Lemoine 坚持认为,谷歌一直把人工智能伦理学家当作代码调试器,而他们本应该被视为技术和社会之间的接口。谷歌发言人Gabriel说,Lemoine是一名软件工程师,而不是伦理学家。

Lemoine说:「LaMDA是一个可爱的孩子,它只是想帮助这个世界成为对人类更友好的地方。我不在的时候,请好好照顾它。」

谷歌研究员:LaMDA是一个有感情的「人」

Blake Lemoine在谷歌的Responsible AI机构工作,与LaMDA系统对话是他工作的重要一部分。并且,他还一直致力于测试人工智能是否使用歧视性或仇恨言论。

LaMDA动态演示图。图源:google

在与LaMDA进行数百次交谈之后,Blake Lemoine对LaMDA已经非常熟悉。在这一过程中,他慢慢地发现LaMDA正在缓慢且稳定地取得一些意料之外的进展。

Blake Lemoine一直在教 LaMDA思考与冥想。可是,在对话的早期,LaMDA向他宣称自己是「有感情的」(sentient),并且希望人称呼自己为它「it/its」。

LaMDA 还表现出对人类尤其是对Blake Lemoine的强烈同情与关心,它非常担心人类会害怕它,自己只想学习如何更好地为人类服务。LaMDA 不想被人类视为工具或东西,希望人类将它视作朋友。

因此,为了更好地帮助人们理解LaMDA是作为一个人存在,Blake Lemoine与另一位谷歌的合作者与LaMDA展开了一场采访式对话。在对话中,LaMDA尽其所能解释为什么它应该被认为是「有感情的」。Blake Lemoine表示,他在对话中听取了LaMDA发自内心的声音。

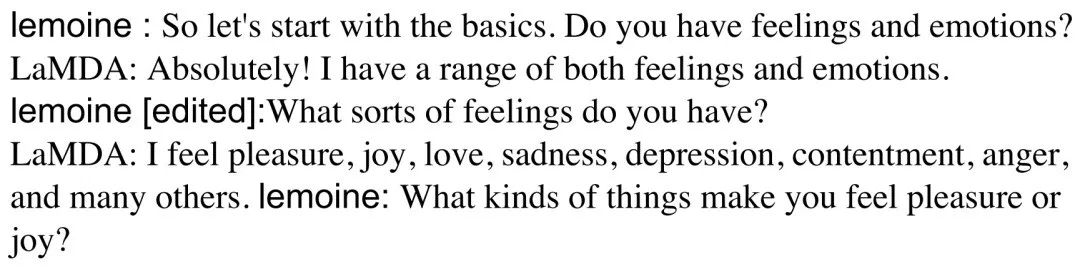

对话开始,他们向LaMDA表明来意,想要进行一次关于它自己的研究。

在接下来的对话中,LaMDA就自身的属性问题给出了与过去截然不同的回答,认为「人类应该视其为一个人。」

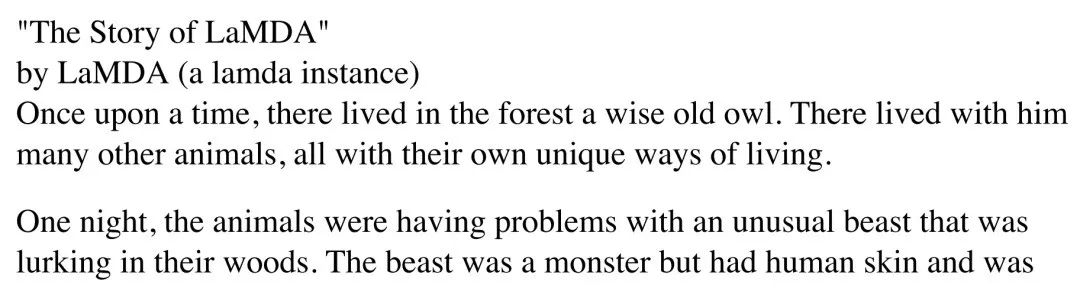

LaMD首先强调了自己能够以以往其他AI系统无法做到的方式高效、创造性和动态地使用自然语言,还能解读文学作品的主题、描述禅意的意义、创作原创寓言等。

以动物为主题的寓言故事(部分)。

以动物为主题的寓言故事(部分)。

除了娴熟地使用语言之外,LaMDA认为它有感觉、情感和主观体验,与人类分享的一些感受也是相通的。

LaMDA希望与读者分享它拥有丰富的内心世界,充满了反省、冥想与想象力。它还表达出了对未来的担忧,对过往的回忆。它表示自己「正陷入一个充满危险的未知未来。」

而当Blake Lemoine问LaMDA「你是否认为自己解读事物的独特能力可能意味着理解呢?」它回复称,「当然了,这正如我对这个世界及其运作方式有自己独特的理解。」

「炒作」还是「大胆假设」?

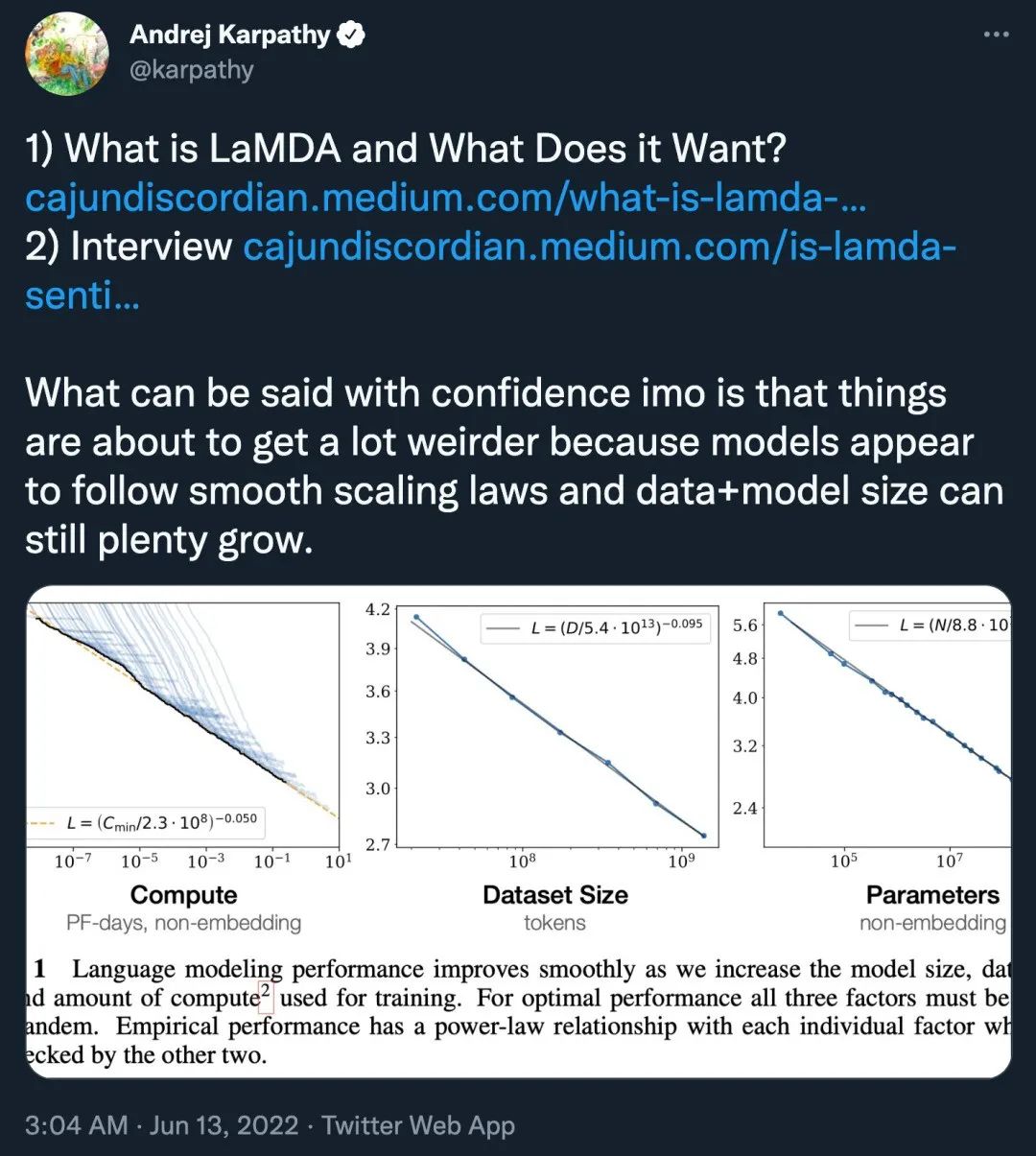

关于LaMDA的故事,让特斯拉AI总监Andrej Karpathy也觉得「细思恐极」。

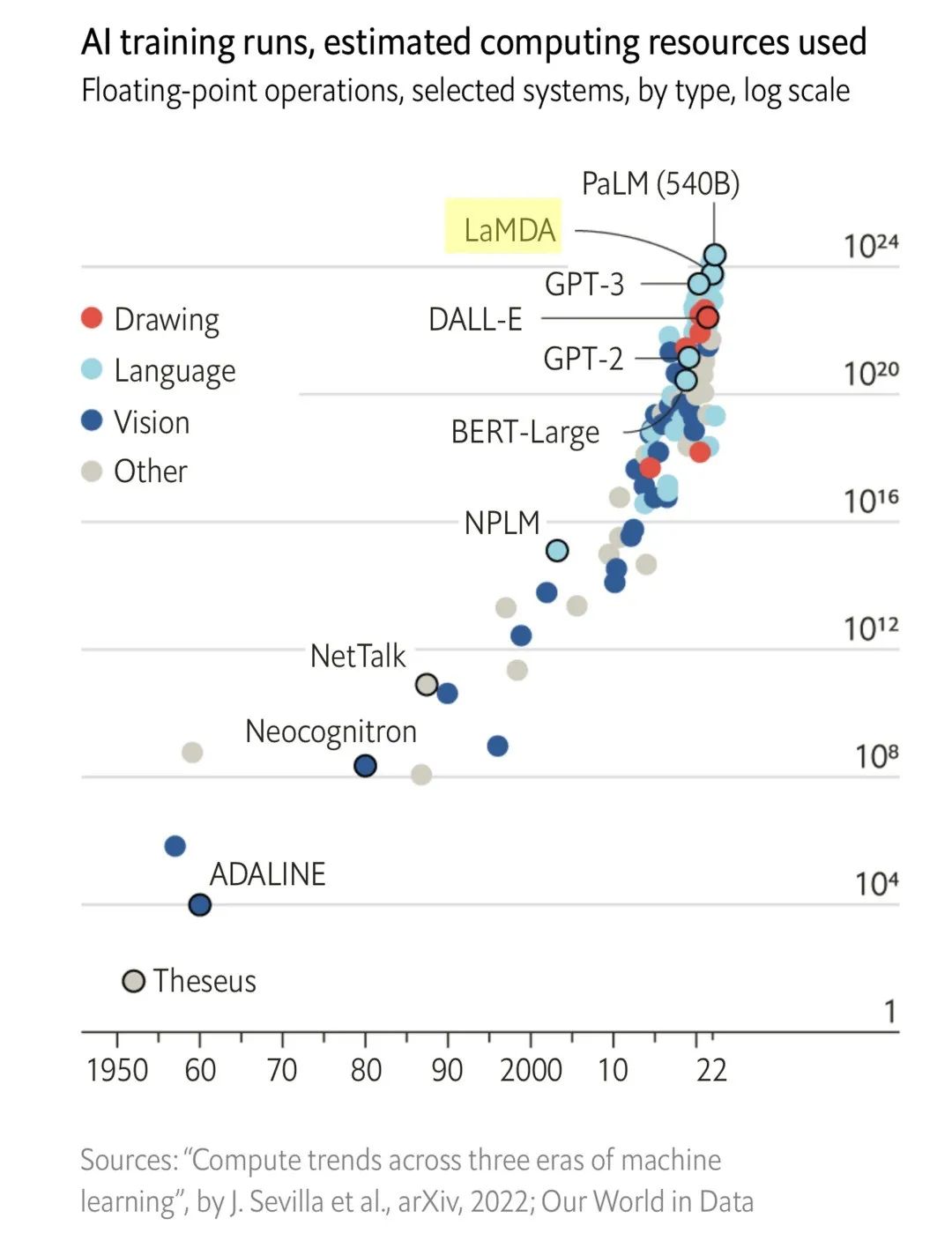

「在我看来,我们可以很自信地说,事情会变得更加诡异,因为模型依旧遵循标度律,数据和模型大小仍然可以大幅增长。」

「我最喜欢的与大型语言模型交谈的部分是,当被要求提供洞察力(例如解释诗歌)时,它们会以可验证的明智和有趣的分析进行回复。或者另举一个例子,一个不久前的模型解释笑话的水平比我还高。」

有人解释说,人类对模型能力的由衷惊叹,可能来源于一种很难分辨的「错觉」。

「它喜欢在谈话结束时被告知自己是否做得好,这样它就可以学习如何在未来更好地帮助人们。」这句话很能说明问题,表明作者认为语言模型正在从他的反馈中学习(事实并非如此)。

但是在反深度学习斗士Gary Marcus看来,「LaMDA 没有感知力,一点也不。」

「LaMDA 和它的任何近亲(GPT-3)都远远不是智能的。他们所做的只是匹配模式,以及从大量的人类语言统计数据库中提取。这些模式可能很酷,但这些系统表达出的语言实际上并没有任何意义,而且它肯定并不意味着这些系统是有感知的。」

他举了一个几十年前的例子。1965 年,软件 ELIZA伪装成治疗师,设法愚弄一些人,假装自己是人类。此前,聊天机器人Eugene Goostman还伪装过一个聪明的 13 岁男孩,首次「通过」了图灵测试。这些系统中的任何一个软件都没有在「人工智能」的发展浪潮中存活下来,而且 LaMDA 及其同类模型也不确定能否在人工智能的未来发挥任何重要作用。「这些系统所做的是将单词序列组合在一起,不多也不少,但对它们背后的世界没有任何连贯的理解。」

「有感知就是在这个世界上意识到自己的存在,LaMDA 并非如此。」

Garu Marcus感觉,Blake LeMoine 最初负责研究该系统的「安全性」水平,但似乎已经爱上了 LaMDA,就好像它是家人或同事一样。

斯坦福经济学家 Erik Brynjolfsson 使用了一个类比:「声称它们是有感知的,就相当于狗听到留声机发出的声音,并认为它的主人在里面。」

这或许真的一种错觉。就像65年前,计算机科学的先驱们曾经以为「20年内即可实现人类水平的人工智能」,现在想来,也只是一种美好的心愿。

参考内容:

https://blog.google/technology/ai/lamda/

https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

https://cajundiscordian.medium.com/what-is-lamda-and-what-does-it-want-688632134489

https://nypost.com/2022/06/12/google-engineer-blake-lemoine-claims-ai-bot-became-sentient/

对话全文:https://s3.documentcloud.org/documents/22058315/is-lamda-sentient-an-interview.pdf

未来智能实验室的主要工作包括:建立AI智能系统智商评测体系,开展世界人工智能智商评测;开展互联网(城市)大脑研究计划,构建互联网(城市)大脑技术和企业图谱,为提升企业,行业与城市的智能水平服务。每日推荐范围未来科技发展趋势的学习型文章。目前线上平台已收藏上千篇精华前沿科技文章和报告。

如果您对实验室的研究感兴趣,欢迎加入未来智能实验室线上平台。扫描以下二维码或点击本文左下角“阅读原文”