一、资源限制

1、资源限制的概念

当定义 Pod 时可以选择性地为每个容器设定所需要的资源数量。 最常见的可设定资源是 CPU 和内存大小,以及其他类型的资源。

当为 Pod 中的容器指定了 request 资源时,调度器就使用该信息来决定将 Pod 调度到哪个节点上。当还为容器指定了 limit 资源时,kubelet 就会确保运行的容器不会使用超出所设的 limit 资源量。kubelet 还会为容器预留所设的 request 资源量, 供该容器使用。

request就是预留值

如果 Pod 运行所在的节点具有足够的可用资源,容器可以使用超出所设置的 request 资源量。不过,容器不可以使用超出所设置的 limit 资源量。

如果给容器设置了内存的 limit 值,但未设置内存的 request 值,Kubernetes 会自动为其设置与内存 limit 相匹配的 request 值。 类似的,如果给容器设置了 CPU 的 limit 值但未设置 CPU 的 request 值,则 Kubernetes 自动为其设置 CPU 的 request 值 并使之与 CPU 的 limit 值匹配。

官网示例:

https://kubernetes.io/docs/concepts/configuration/manage-compute-resources-container/

2、Pod 和 容器 的资源请求和限制:

spec.containers[].resources.requests.cpu //定义创建容器时预分配的CPU资源

spec.containers[].resources.requests.memory //定义创建容器时预分配的内存资源

spec.containers[].resources.limits.cpu //定义 cpu 的资源上限

spec.containers[].resources.limits.memory //定义内存的资源上限

3、CPU 资源单位

CPU 资源的 request 和 limit 以 cpu 为单位。Kubernetes 中的一个 cpu 相当于1个 vCPU(1个超线程)。

Kubernetes 也支持带小数 CPU 的请求。spec.containers[].resources.requests.cpu 为 0.5 的容器能够获得一个 cpu 的一半 CPU 资源(类似于Cgroup对CPU资源的时间分片)。表达式 0.1 等价于表达式 100m(毫核),表示每 1000 毫秒内容器可以使用的 CPU 时间总量为 0.1*1000 毫秒。

Kubernetes 不允许设置精度小于 1m 的 CPU 资源。

4、内存 资源单位

内存的 request 和 limit 以字节为单位。可以以整数表示,或者以10为底数的指数的单位(E、P、T、G、M、K)来表示, 或者以2为底数的指数的单位(Ei、Pi、Ti、Gi、Mi、Ki)来表示。

如:1KB=10^3=1000,1MB=10^6=1000000=1000KB,1GB=10^9=1000000000=1000MB

1KiB=2^10=1024,1MiB=2^20=1048576=1024KiB

PS:在买硬盘的时候,操作系统报的数量要比产品标出或商家号称的小一些,主要原因是标出的是以 MB、GB为单位的,1GB 就是1,000,000,000Byte,而操作系统是以2进制为处理单位的,因此检查硬盘容量时是以MiB、GiB为单位,1GiB=2^30=1,073,741,824,相比较而言,1GiB要比1GB多出1,073,741,824-1,000,000,000=73,741,824Byte,所以检测实际结果要比标出的少一些。

示例1:

apiVersion: v1

kind: Pod

metadata:name: pod-resourcesnamespace: dev

spec:containers:- name: nginximage: nginx:1.17.1resources: # 资源配额limits: # 限制资源(上限)cpu: "2" # CPU限制,单位是core数 memory: "10Gi" # 内存限制requests: # 请求资源(下限)cpu: "1" # CPU限制,单位是core数memory: "10Mi" # 内存限制 #以上是可以正常创建pod的,然后再将requests的最小内存限制改为10Gi,再创建pod,查看是否创建成功#发现是无法创建成功的,因为requests最小请求量不仅需要满足容器内部的应用启动大小, 也需要在当前node节点上能划分出该设定的资源的。不然资源无法请求成功到,容器也无法运行。

kubectl apply -f pod-resources.yaml

kubectl get pods -n dev

kubectl describe pod pod-resources -n dev

#查看详细信息kubectl logs pod-resources -c nginx

#查看对象的容器日志信息

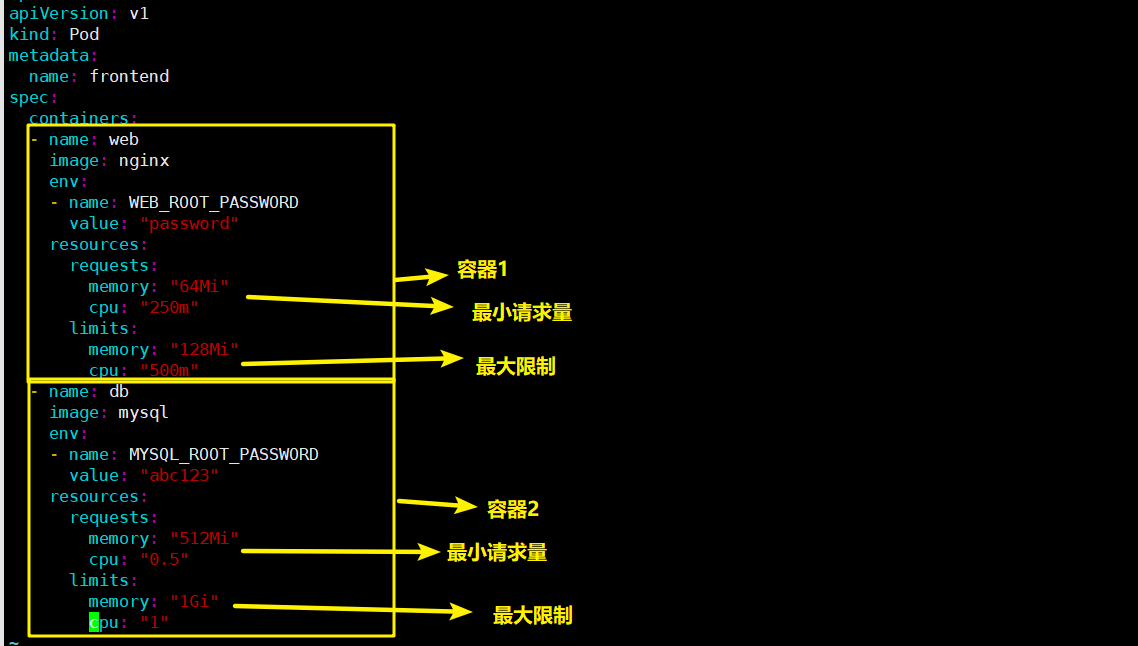

此例子中的 Pod 有两个容器。每个容器的 request 值为 0.25 cpu 和 64MiB 内存,每个容器的 limit 值为 0.5 cpu 和 128MiB 内存。那么可以认为该 Pod 的总的资源 request 为 0.5 cpu 和 128 MiB 内存,总的资源 limit 为 1 cpu 和 256MiB 内存。

示例2:

apiVersion: v1

kind: Pod

metadata:name: frontend

spec:containers:- name: webimage: nginxenv:- name: WEB_ROOT_PASSWORDvalue: "password"resources:requests:memory: "64Mi"cpu: "250m"limits:memory: "128Mi"cpu: "500m"- name: dbimage: mysqlenv:- name: MYSQL_ROOT_PASSWORDvalue: "abc123"resources:requests:memory: "512Mi"cpu: "0.5"limits:memory: "1Gi"cpu: "1"

kubectl create -f pod-resource2.yaml

kubectl get pods -owide

kubectl describe pods frontend

kubectl describe nodes node02

二:健康检查:又称为探针(Probe)

探针是由kubelet对容器执行的定期诊断。

1、探针的三种规则:

●存活探针(livenessProbe) :判断容器是否正在运行。如果探测失败,则kubelet会杀死容器,并且容器将根据容器策略来决定是否重启。 如果容器不提供存活探针,则默认状态为Success。

●就绪探针(readinessProbe) :判断容器是否准备好接受请求。如果探测失败,就会加入notready状态,并且service资源的endpoints中剔除,service将不会把访问请求转发给这个pod

●启动探针(startupProbe)(这个1.17版本增加的):判断容器内的应用程序是否已启动,在探测成功转换为suuccess之前,其他探针都会处于失效状态。

#注:以上规则可以同时定义。在readinessProbe检测成功之前,Pod的running状态是不会变成ready状态的。

2、Probe支持三种检查方法:

●exec :在容器内执行指定命令。如果命令退出时返回码为0则认为诊断成功。

●tcpSocket :对指定端口上的容器的IP地址进行TCP检查(三次握手)。如果端口打开,则诊断被认为是成功的。

●httpGet :对指定的端口和路径上的容器的IP地址执行HTTPGet请求。如果响应的状态码大于等于200且小于400,则诊断被认为是成功的。

每次探测都将获得以下三种结果之一:

●成功:容器通过了诊断。

●失败:容器未通过诊断。

●未知:诊断失败,因此不会采取任何行动

官网示例:

https://kubernetes.io/docs/tasks/configure-pod-container/configure-liveness-readiness-startup-probes/

示例1:exec方式

apiVersion: v1

kind: Pod

metadata:name: pod-liveness-execnamespace: dev

spec:containers:- name: nginximage: nginx:1.17.1ports: - name: nginx-portcontainerPort: 80livenessProbe:exec:command: ["/bin/cat","/tmp/hello.txt"] # 执行一个查看文件的命令

kubectl create -f pod-liveness-exec.yaml

#创建podkubectl describe pods pod-liveness-exec -n dev

#查看pod详情kubectl get pods pod-liveness-exec -n dev

#查看pod的状态//以上进行探测的时候,会探测失败,所以就导致pod不停的重启,后面将command命令中的执行命令换成可执行的正常命令即可。

#initialDelaySeconds:指定 kubelet 在执行第一次探测前应该等待5秒,即第一次探测是在容器启动后的第6秒才开始执行。默认是 0 秒,最小值是 0。

#periodSeconds:指定了 kubelet 应该每 5 秒执行一次存活探测。默认是 10 秒。最小值是 1。

#failureThreshold: 当探测失败时,Kubernetes 将在放弃之前重试的次数。 存活探测情况下的放弃就意味着重新启动容器。就绪探测情况下的放弃 Pod 会被打上未就绪的标签。默认值是 3。最小值是 1。

#timeoutSeconds:探测的超时后等待多少秒。默认值是 1 秒。最小值是 1。(在 Kubernetes 1.20 版本之前,exec 探针会忽略 timeoutSeconds 探针会无限期地 持续运行,甚至可能超过所配置的限期,直到返回结果为止。)

可以看到 Pod 中只有一个容器。kubelet 在执行第一次探测前需要

示例2:httpGet方式

apiVersion: v1

kind: Pod

metadata: labels:test: livenessname: liveness-execnamespace: dev

spec:containers:- name: livenessimage: busyboximagePullPolicy: IfNotPresentargs:- /bin/sh- -c- touch /tmp/healthy;sleep 30;rm -rf /tmp/healthy;sleep 60livenessProbe:exec:command:- cat- /tmp/healthyfailureThreshold: 1initialDelaySeconds: 5periodSeconds: 5

------------------------------------------------------------

failureThreshold: # 当探测失败是,k8s将在放弃之前重试次数。存活探测情况下的放弃就意味着重新启动。就绪性探测情况下放弃Pod 会被打伤未就绪的标签,默认值是3,最小值是1。

(简单理解:就是探测的失败次数,允许连续探测几次)initialDelaySeconds: #指定kubelet在执行第一次探测前应该等待的时间,也就就是第一次探测的时间初始化结束后的第1秒,初始化时间默认0秒,最小值0秒。

(简单理解:就是每次的第一次探测前需要等待的时间,如果探测多次,不用等待)periodSeconds: #指定了kubelet 应该多久时间执行一次探测,默认10秒,最小值是1秒。timeoutSeconds: #探测的超时后等待多少秒,默认值是1秒,最小值是1秒。(在kubernetes 1.20版本之前,exec探针会忽略此事件,探针会无限期的持续运行,升值可能超过所配置的限期,知道返回结果为止)

下面进行创建pod,观察探测结果

kubectl create -f pod-liveness2.yaml

#创建podkubectl get pods -n dev -w

#提前时实监控一个pod

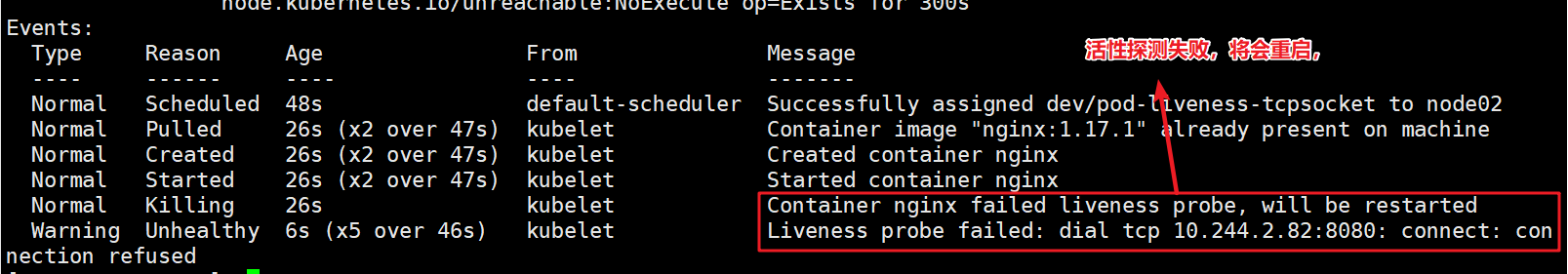

示例3:tcpSocket方式

apiVersion: v1

kind: Pod

metadata:name: pod-liveness-tcpsocketnamespace: dev

spec:containers:- name: nginximage: nginx:1.17.1ports: - name: nginx-portcontainerPort: 80livenessProbe:tcpSocket:port: 8080 # 尝试访问8080端口

kubectl create -f pod-liveness-tcpsocket.yaml

#创建podkubectl get pods pod-liveness-tcpsocket -n dev

#查看容器状态kubectl describe pods pod-liveness-tcpsocket -n dev

#查看容器的详细状态//观察上面的信息,发现尝试访问8080端口,但是失败了

//稍微一会之后,再观察pod信息,就可看到RESTART不再是0 ,而是一直增长。表示pod在重启

#当然接下来,可以修改一个可以访问的端口,比如80,正常访问后,活性检测就正常。

![【NLP】什么是语义搜索以及如何实现 [Python、BERT、Elasticsearch]](http://pic.xiahunao.cn/【NLP】什么是语义搜索以及如何实现 [Python、BERT、Elasticsearch])