Batch Nomalization

1.Batch Nomalization原理

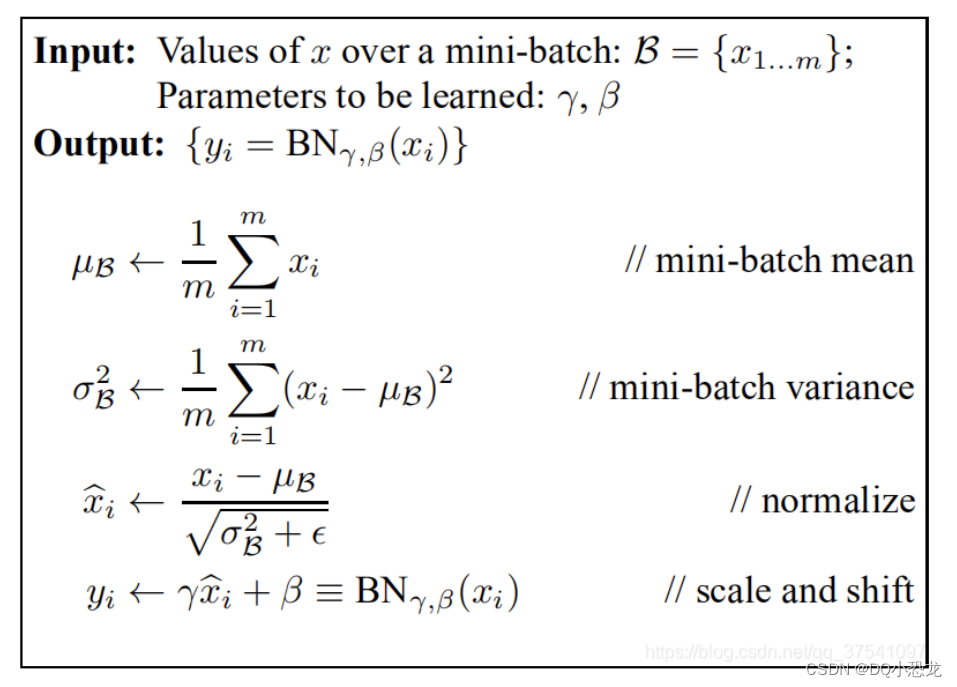

图像预处理过程中通常会对图像进行标准化处理,这样能够加速网络的收敛。就是按照channel去求均值和方差,然后原数据减均值除标准差,使我们的feature map满足均值为0,方差为1的分布规律。

其中,伽马和白塔是两个参数,调整获得高斯分别均值和方差,使其更好的训练。这两个参数是在反向传播过程中得到的。

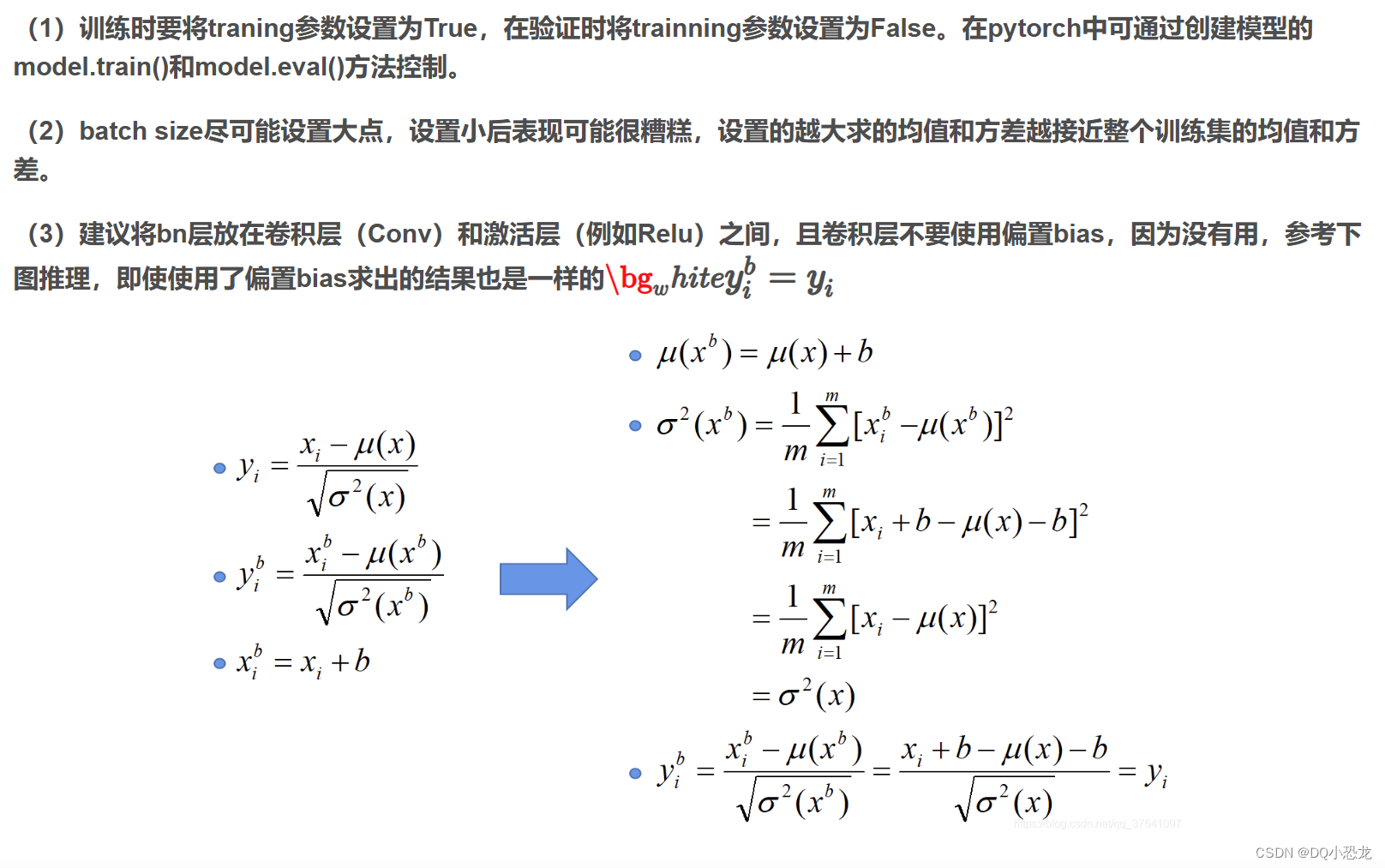

2.使用BN层注意事项

参考博客:

Batch Normalization详解以及pytorch实验_pytorch batch normalization-CSDN博客![]() https://blog.csdn.net/qq_37541097/article/details/104434557?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522170979070916800225578151%2522%252C%2522scm%2522%253A%252220140713.130102334.pc%255Fblog.%2522%257D&request_id=170979070916800225578151&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~blog~first_rank_ecpm_v1~rank_v31_ecpm-1-104434557-null-null.nonecase&utm_term=BN&spm=1018.2226.3001.4450

https://blog.csdn.net/qq_37541097/article/details/104434557?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522170979070916800225578151%2522%252C%2522scm%2522%253A%252220140713.130102334.pc%255Fblog.%2522%257D&request_id=170979070916800225578151&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~blog~first_rank_ecpm_v1~rank_v31_ecpm-1-104434557-null-null.nonecase&utm_term=BN&spm=1018.2226.3001.4450

迁移学习

1.优势

1.快速训练理想结果

2.较小数据集也可以获得理想效果

注:使用别人的预训练模型参数时,注意别人图像预处理的方式。保持一致,不然效果可能很差!

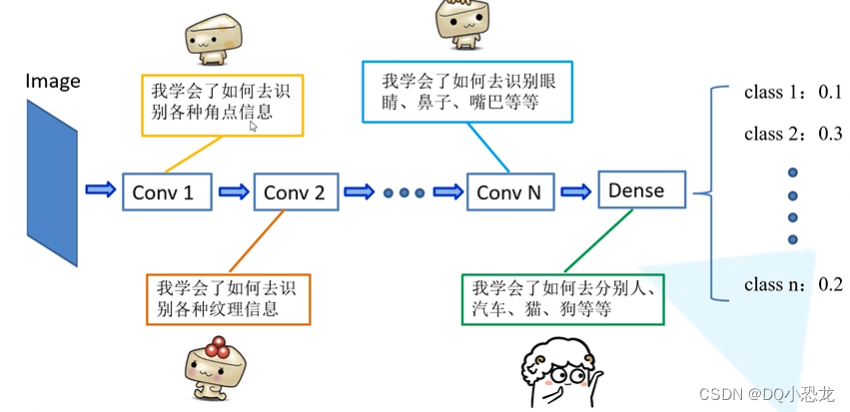

2.简介

3.常见迁移学习方式

1.载入权重后训练所以参数 ->按理说效果最好

2.载入权重后只训练最后几层参数

3.载入权重后在原网络基础上再添加一层全连接层,仅仅训练最后一个全连接层。

显示信息弹框/标签)

)

)

跳跃游戏II(c++))

探针的简介(7))

、linux快速上手)