前两天老大布置一个任务,说爬下来的数据要存入数据库中,丢给我一个peewee,说用这个。当时的我两眼一抹黑,这是个什么东西呀,我知道scrapy的数据存入数据库是在pipelines中进行设置但是peewee是什么东西呢。经过两天不懈的努力,终于呀成功了

peewee

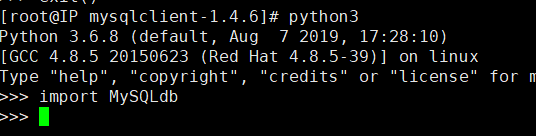

peewee 是一款数据库 ORM 库,可以很方便的帮你把对象和数据库表进行映射,从而让你不用写一句 SQL 就能操作数据库,我们爬到的数据需要写到 mysql 数据库中。

这句话就是说当我们数据库设置好字段时,可以通过这个库直接生成一个包含数据库表的所有字段和字段的各种设置

数据库表字段

peewee可以用一条命令生成关于该数据库表的字段设置

从现有数据库生成相应的模块,使用pwiz实现

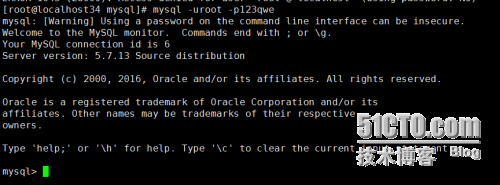

python -m pwiz -e mysql -H localhost -u root -P root user > md.py

python3 -m pwiz -e mysql(数据库) -H 服务器名 -p 端口号 -u 用户名 -P 密码 数据库名称 > 生成文件名

生成文件

from peewee import *

database = MySQLDatabase('user', **{'host': 'localhost', 'password': 'root', 'user': 'root'})

class UnknownField(object):

def __init__(self, *_, **__): pass

class BaseModel(Model):

class Meta:

database = database

class Art(BaseModel):

inc = TextField()

top = TextField()

m5d = CharField(index=True, null=True)

wfrm = TextField(null=True)

html = CharField()

class Meta:

db_table = 'db'

indexes = (

((''inc'), False),

(('wfrm'), False),

)

model与fields

对应关系:

在peewee中,一个继承model类的类定义为某个数据库的一个表格,如上面我们的art表就是继承baseModel类。类中的field为数据库中的列(字段)

OK,生成db.py后放在scrapy中与pilelines同一级目录下

pipelines

在pileline中引入该文件(不要忘了db文件前还有一个".")

from .db import Art

pipelines中我定义了两个类,一个类用于把数据输出为json格式,一个类用于把数据保存到数据库中

import codecs

import json

class WccPlaPipeline(object):

def __init__(self):

self.file = codecs.open("保存的文件名.json","wb",encoding="utf-8")

#这个方法必须返回一个Item对象,参数item:被爬取的item

#spider爬取该item的spider

def process_item(self, item, spider):

#打开JSON文件,向里面以dumps的方式吸入数据,

#其中ensure_ascii=False,不然数据会直接为utf编码的方式存入

line = json.dumps(dict(item),ensure_ascii=False)+'\n'

self.file.write(line)

return item

class MysqlPipeline(object):

def process_item(self,item,spider):

if Art.table_exists() == False:

Art.create_table()

data = Art(title=item['title'],text=item['text'])

data.save()

return item

json文件和自编写的spider在同一级目录下,这里我只用了peewee的插入语句,对其他语句感兴趣的小伙伴可以自行百度哦

settings的设置

由于pipelines中定义了两个类,所以要在settings中给这两个类设置一个执行的优先级顺序

ITEM_PIPELINES = {

'项目名.pipelines.MysqlPipeline': 300,

'项目名.pipelines.Pipeline': 100,

}

这样就可以执行scrapy啦