1. 数据准备:收集数据与读取

2. 数据预处理:处理数据

3. 训练集与测试集:将先验数据按一定比例进行拆分。

4. 提取数据特征,将文本解析为词向量 。

5. 训练模型:建立模型,用训练数据训练模型。即根据训练样本集,计算词项出现的概率P(xi|y),后得到各类下词汇出现概率的向量 。

6. 测试模型:用测试数据集评估模型预测的正确率。

混淆矩阵

准确率、精确率、召回率、F值

import csv

file_path =r'E:\jupyter\SMSSpamCollectionjsn.txt'#原始的邮件

sms=open(file_path,'r',encoding='utf-8')

csv_reader=csv.reader(sms,delimiter='\t')

sms_data=[]#邮件的内容

sms_label=[]#邮件的类别

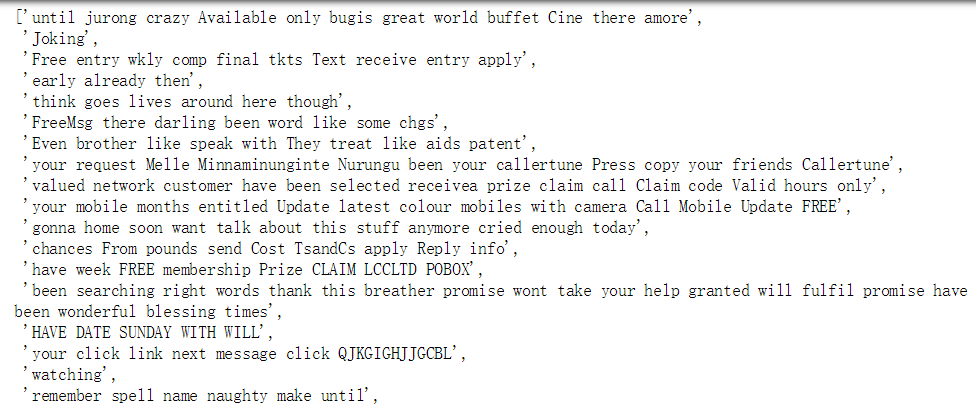

for line in csv_reader:sms_label.append(line[0])sms_data.append(line[1])

sms.close()#对数据预处理

sms_data1 = []#存放处理过的邮件

for line in sms_data:#对邮件的内容进行处理for k in line:if k.isalpha() is False:# 不是字母,发生替换操作:newString = line.replace(k," ")dataList = newString.split(" ")sms_data1.append(dataList)#去掉长度小于3的词和没有语义的词

sms_data2= []

for line in sms_data:dataList = []for i in line:if i != '' and len(i) > 3 and i.isalpha():dataList.append(i)dataString = ' '.join(dataList)sms_data.append(dataString)

sms_data =sms_data2##训练集与测试集:将先验数据按一定比例进行拆分

from sklearn.model_selection import train_test_split

x_train,x_test,y_train,y_test = train_test_split(sms_data2,sms_label,test_size=0.3,random_state=0,stratify=sms_label)#提取数据特征,将文本解析为词向量

from sklearn.feature_extraction.text import TfidfVectorizer

vectorizer=TfidfVectorizer(min_df=2,ngram_range=(1,2),stop_words='english',strip_accents='unicode',norm='l2')

X_train=vectorizer.fit_transform(x_train)

X_test=vectorizer.transform(x_test)#朴素贝叶斯分类器

from sklearn.navie_bayes import MultinomialNB

clf= MultinomialNB().fit(X_train,y_train)

y_nb_pred=clf.predict(X_test)#分类结果显示

from sklearn.metrics import confusion_matrix

from sklearn.metrics import classification_report

print(y_nb_pred.shape,y_nb_pred)#x_test预测结果

print('nb_confusion_matrix:')

cm=confusion_matrix(y_test,y_nb_pred)#混淆矩阵

print(cm)

print('nb_classification_report:')

cr=classification_report(y_test,y_nb_pred)#主要分类指标的文本报告

print(cr)

:字符串tocharArray,tolowercase,touppercase方法)

:StringBuilder)

)

:StringBuilder连接字符串和删除操作)

:StringBuilder,stringbuffer,string区别)

)

:日期date类)

)

动画)

:日期时间格式化)